Considérons le problème classique consistant à compresser une source (observée par un capteur, Alice) pour qu’elle puisse être estimée avec un niveau de distorsion fixé à une certaine destination (Bob), un lien public à débit limité étant disponible entre les deux appareils. Ce lien est supposé parfaitement accessible à un adversaire (Ève), par exemple un capteur corrompu, qui dispose également de sa propre observation corrélée à la source. Lors de la communication, l’encodeur souhaite dévoiler aussi peu que possible sa source à l’adversaire. Un autre capteur (Charlie) peut aider Bob à estimer la source d’Alice en envoyant une version compressée de sa propre observation (corrélée à la source) via un lien privé à débit limité, uniquement observé par Bob. Dans ce contexte, la corrélation entre les observations peut être utile, non seulement pour diminuer les débits de transmission, mais aussi pour augmenter la sécurité du système, définie ici par l’incertitude de Ève à propos de la source d’Alice. D’un point de vue théorique, le problème considéré ici est très riche et toujours non résolu, dans la mesure où il contient, comme sous-problèmes, celui de la compression distribuée avec perte, ouvert de longue date, ainsi que celui du codage de source avec contrainte de sécurité, plus récemment étudié.

Slepian et Wolf [143] ont introduit le problème de compression distribuée sans perte, où Bob souhaite estimer parfaitement les sources d’Alice et Charlie. Wyner [163] et Ahlswede et Körner [4] ont par la suite caractérisé la région atteignable lorsqu’une seule source doit être estimée (codage de source avec information adjacente partielle). La généralisation du contexte de Slepian-Wolf à des niveaux de distorsion arbitraires pour chaque source a été introduit par Berger [9]. Ce dernier a de plus fourni des bornes intérieure et extérieure à la région atteignable correspondante, distinctes dans le cas général. De nombreux résultats d’optimalité ont été démontrés dans les cas d’information adjacente non codée [166], de recontruction parfaite d’au moins une source [12], et dans certains cas particuliers, dont celui des sources gaussiennes avec mesure de distorsion quadratique [119, 158]. Dans les dernières décennies, ces sujets ont été l’objet d’intenses recherches, et des progrès remarquables ont été réalisés des points de vue théorique et pratique. Ceux-ci incluent la définition d’un cadre général pour la compression sans perte avec de multiples terminaux [33, 63], le codage de source avec perte en présence d’information adjacente incertaine au récepteur [66, 73], la compression avec perte pour des encodeurs partiellement séparés [72] ou plusieurs décodeurs [150–152], des résultats d’optimalité pour des sources gaussiennes dans divers contextes [134,148], ainsi que la conception de codes imbriqués pour la compression distribuée en utilisant par ex., les codes par contrôle de parité [174], par réseaux [98,138,174], ou par treillis algébriques [132]. Malgré ces avancées, le simple problème de la compression distribuée avec perte, introduit par Berger [9], est toujours ouvert.

D’autre part, la problématique des communications sécurisées a généré de très nombreux travaux. L’attention s’est particulèrement portée sur la cryptographie traditionnelle, basée sur la complexité computationnelle. Dans cette approche, la sécurité repose uniquement sur l’hypothèse que certains problèmes ne peuvent être résolus en pratique en temps raisonnable. En 1949, Shannon [140] a défini une notion de la sécurité en termes d’information, dans laquelle le niveau de secret est mesuré via l’incertitude de l’espion à propos du message. Cette approche permet de considérer les problématiques de sécurité au niveau de la couche physique, et assure une sécurité inconditionnelle, indépendamment des capacités de l’espion. Utilisant cette notion dans une perspective de codage de canal, Wyner a introduit le canal wiretap [165] et montré qu’il est possible de transmettre de l’information avec une sécurité maximale dès lors que le canal de l’espion est une version dégradée de celui de l’utilisateur légitime. Csiszàr et Körner [32] ont étendu ce résultat au cas général des canaux de diffusion avec une incertitude arbitraire. Depuis, de nombreuses extensions ont été proposées [1, 90, 95], par ex. pour les canaux à évanouissement [89], de même que des schémas de codage pratiques pour les communications sécurisées, par ex. des codes imbriqués pour les canaux wiretap de type-II [96] et la construction de codes spécifiques pour la sécurité à partir de codes ordinaires [65]. Cependant, peu de travaux existent en ce qui concerne le codage de source avec contrainte de sécurité, alors qu’il a été démontré que la présence de corrélation entre différentes observations permet de garantir une certaine sécurité .

Transmission sécurisée d’une source via un canal bruité, avec information adjacente aux récepteurs

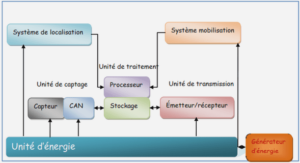

Considérons un système composé de trois nœuds (ou capteurs), chacun mesurant une source analogique. L’un deux (Alice) souhaite transmettre une version compressée de son observation à un second nœud (Bob) via un canal bruité (sans fil). Bob peut bien sûr utiliser sa propre observation comme information adjacente, pour décoder le message reçu et affiner son estimée de la source d’Alice. Le troisième nœud (Ève) est un espion : il peut écouter les messages envoyés par Alice via un autre canal bruité. Considérant que Ève n’est pas digne de confiance (c’est un ennemi, ou un capteur piraté en cours d’opération), Alice souhaite dévoiler aussi peu que possible sa source à cet adversaire.

Ce problème touche à des problématiques majeures de la théorie de l’information, parmi lesquelles la notion de sécurité (ou secret), et son application aux codages de source et de canal, le codage de source avec information adjacente, ainsi que le codage conjoint de source-canal pour la transmission de sources via des canaux bruités. La notion de sécurité, introduite dans la théorie de l’information par Shannon [140], a tout d’abord été utilisée pour les transmissions sécurisées via des canaux bruités par Wyner [165], qui a défini le canal wiretap, par la suite étendu par Csiszár et Körner [32]. D’autre part, le codage de source avec information adjacente a été introduit par Slepian et Wolf [143], et Wyner et Ziv [166].

La plupart des travaux existants considèrent séparément les codages de source et de canal pour les transmission sécurisées. Cependant, contrairement au cas des communications point-à-point [107, 139], il n’existe aucun résultat général de séparation pour de tels problèmes à plusieurs terminaux. Récemment, Merhav [106] a considéré le codage de source-canal pour les transmissions sécurisées, en supposant que l’information adjacente et le canal de Ève sont dégradés par rapport à ceux de Bob ; dans ce cas, il est montré que le principe de séparation est satisfait. Ce résultat pourrait indiquer que les schémas numériques sont bien adaptés aux problèmes des tranmissions sécurisées. D’autre part, il est bien connu que les codes conjoints sont essentiels pour les canaux de diffusion classiques [47, 155], et que les schémas hybrides analogiques/numériques sont utiles (par ex. pour gérer la connaissance imparfaite du rapport signal à bruit (SNR mismatch) dans les communications point-à-point [109, 161], mais aussi pour quelques problèmes à plusieurs terminaux [45,57,91]). En tirant avantage des stratégies analogiques et numériques, ces derniers pourraient aider à résoudre le problème de transmission sécurisée considéré dans un cas plus général, sans condition de « dégradation ».

Notations

Pour toute suite (xi)i∈N∗ , xⁿₖ désigne la collection (xk, xk+1, . . . , xn). L’entropie est notée H(·), et l’information mutuelle I(·; ·). On désigne les ensembles typiques et conditionnellement typiques par Tⁿδ (X) et Tⁿδ (Y |xⁿ), resp. (voir l’annexe A). Soient X, Y et Z trois variables aléatoires de distribution p. Si p(x|yz) = p(x|y) pour tous x, y, z, alors elles forment une chaîne de Markov, notée X − −Y − −Z. La variable aléatoire Y est dite moins bruitée que Z par rapport à X si I(U; Y ) ≥ I(U;Z) pour toute variable aléatoire U telle que U − −X− −(Y, Z) forment une chaîne de Markov. Cette relation est notée Y ≥X Z. L’ensemble des nombres réels positifs est noté R+. Pour tout x ∈ R, [x]+ désigne max{0 ; x}. Les logarithmes sont pris en base 2 et notés log(·). L’entropie binaire est définie sur [0 ; 1] par h2(x) = −x log(x −(1−x) log(1−x). Son inverse h₂⁻¹ est définie sur [0 ; 1] et à valeurs dans [0 ; ½]. Pour tous a, b ∈ [0 ; 1], a ⋆ b = a(1 − b) + (1 − a)b. La distribution de Bernoulli de paramètre u est notée B(u).

|

Table des matières

1 Introduction

1.1 Préliminaires

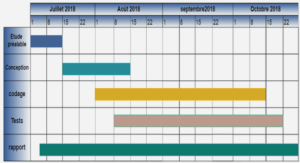

1.2 Systèmes pratiques

1.3 Stratégies ciblées

1.3.1 Codage de source pour les transmissions sécurisées

1.3.2 Codage de source pour la détection

2 Codage de source à plusieurs terminaux sous contrainte de sécurité

2.1 Introduction

2.2 Codage de source avec perte sous contrainte de sécurité, avec information adjacente codée

2.2.1 Définitions

2.2.2 Borne intérieure

2.2.3 Borne extérieure

2.3 Démonstration du théorème 2.1 (Borne intérieure)

2.3.1 Encodage à Alice et Charlie

2.3.2 Décodage à Bob

2.3.3 Incertitude à Ève

2.3.4 Fin de la démonstration

2.4 Codage de source avec perte sous contrainte de sécurité, avec information adjacente non codée

2.4.1 Définitions

2.4.2 Caractérisation optimale

2.4.3 Caractérisation alternative

2.4.4 Cas particuliers

2.5 Compression sans perte distribuée sous contrainte de sécurité

2.5.1 Définitions

2.5.2 Caractérisation optimale

2.5.3 Caractérisation alternative

2.6 Exemples d’application

2.6.1 Sources gaussiennes avec information adjacente codée

2.6.2 Source binaire avec informations adjacentes CBE/CBS

2.7 Conclusion

3 Transmission sécurisée d’une source via un canal bruité, avec information adjacente aux récepteurs

3.1 Introduction

3.2 Définitions et borne extérieure générale

3.2.1 Définitions

3.2.2 Borne extérieure générale

3.3 Schéma numérique

3.3.1 Énoncé général

3.3.2 Schéma basé sur une séparation « opérationnelle »

3.3.3 Cas particuliers

3.4 Démonstration du théorème 3.2 (Schéma numérique)

3.4.1 Encodage

3.4.2 Décodage

3.4.3 Incertitude à Ève

3.4.4 Résumé des conditions suffisantes

3.4.5 Ajout d’un pré-canal

3.5 Transmission d’une source binaire avec informations adjacentes CBE/CBS via un canal wiretap de type II

3.5.1 Modèle

3.5.2 Performances de quelques schémas de codage

3.5.3 Contre-exemple à l’optimalité du théorème 3.2

3.6 Codage hybride

3.6.1 Énoncé général

3.6.2 Cas particuliers

3.7 Démonstration du théorème 3.8 (Schéma hybride)

3.7.1 Encodage

3.7.2 Décodage

3.7.3 Incertitude à Ève

3.7.4 Fin de la démonstration

3.8 Transmission d’une source binaire via un canal wiretap de type II (suite)

3.8.1 Codage hybride

3.8.2 Résultats numériques

3.9 Transmission d’une source gaussienne via un canal wiretap gaussien

3.9.1 Modèle

3.9.2 Codage hybride

3.9.3 Cas particulier : PY < PZ, PB → ∞

3.10 Conclusion

4 Conclusion