Reconnaissance vocale

La reconnaissance vocale

La reconnaissance vocale est la technique qui permet l’analyse des sons captés par un microphone pour les transcrire sous forme d’une suite de mots exploitables par les machines. Depuis son apparition dans les années 1950, la reconnaissance vocale a été constamment améliorée avec l’aide des phonéticiens, linguistes, mathématiciens et ingénieurs, qui ont défini les connaissances acoustiques et linguistiques nécessaires pour bien comprendre la parole d’un humain. Cependant, les performances atteintes ne sont pas parfaites et dépendent de nombreux critères. Les conditions favorables pour la reconnaissance de la parole impliquent une parole native, appartenant à un seul locuteur ayant une diction propre (ne présentant pas une pathologie de voix), enregistrée dans un environnement calme et non bruité, basée sur un vocabulaire commun (mots connus par le système). La performance du système diminue lorsque l’on traite des accents nonnatifs, différents dialectes, des locuteurs qui présentent une pathologie de voix, des mots inconnus par le système (généralement des noms propres), des signaux audio bruités (faible rapport signal-à-bruit), etc.

Le son

Les sons qui parviennent à nos oreilles résultent de vibrations de l’air. Sous une excitation mécanique produite par un instrument de musique ou une personne qui parle, l’air se met à vibrer. Une molécule reçoit alors une impulsion qui la met en mouvement dans une direction donnée. Sur son parcours, elle rencontre d’autres molécules qu’elle pousse, formant ainsi une zone de compression. L’air possède une certaine élasticité, il ne tarde donc pas à se détendre. La matière traversée par l’onde acoustique est alors le siège de compressions et de dépressions successives et périodiques. Ce phénomène crée une onde progressive longitudinale. Ces mouvements se propagent à une vitesse qui dépend du milieu (élément traversé) et des conditions (température, pression). Dans l’air calme, sous une pression atmosphérique normale et à 20° C, la vitesse de propagation du son est de 340 m/s. Dans un milieu homogène, les vibrations se propagent uniformément dans toutes les directions, mais elles finissent par s’amortir progressivement. L’amortissement est d’autant plus important que la fréquence est élevée. En conséquence, les sons aigus portent moins loin que les sons graves à intensité égale. On sait maintenant pourquoi nos voisins n’aiment pas nos chaînes HIFI. Pour que le son se propage, la présence d’un milieu élastique est indispensable : le son ne se propage pas dans le vide. Ajoutons également que les molécules vibrent sur place. Un son sortant d’un haut-parleur n’a jamais créé de courant d’air !

Les sons simples et sons complexes

Ce graphique représente un son simple ou “pur”, mais ce cas est très rare. En effet, la plupart des sources sonores produisent des sons complexes qui sont constitués par une fréquence fondamentale sur laquelle se superposent des harmoniques et des transitoires. Les harmoniques sont des multiples entiers de la fréquence fondamentale. On distingue les harmoniques pairs (2f, 4f, 6f, 8f…) et les harmoniques impairs (3f, 5f, 7f, 9f…). Les sons sont donc formés d’une superposition de vibrations ayant des amplitudes très variables dont la courbe résultante est très irrégulière. Le théorème de Fourier permet de démontrer qu’un signal complexe peut être décomposé en une série de signaux sinusoïdaux simples. Les transitoires sont constituées à l’établissement ou l’extinction d’un son d’une manière brusque comme par exemple les percussions, les cymbales, ou l’attaque d’une note de piano. Les transitoires ne sont pas décomposables en série de Fourier.

Un fichier audio numérique :

La reconnaissance vocale se base sur la comparaison de fichiers audio, ainsi nous devons tout d’abord maîtriser le format d’enregistrement utilisé avant d’effectuer des opérations de transformation du signal. On distingue deux types de format, les formats compressés et les formats non compressés. Le format WAVE (Waveform) est un dérivé de la spécification RIFF (Resource Interchange File Format) de Microsoft dédiée au stockage de données multimédias. Ce format est libre d’utilisation et est sûrement le plus répandu parmi les nombreux formats de fichiers sons. Ce format est lisible sur la plupart des systèmes d’exploitation et par n’importe quel logiciel de traitement de son digne de ce nom. Le seul problème avec ce format est qu’il est évolutif et peut connaître de nombreuses formes (compressions audio, etc.). Nous allons donc nous limiter au format PCM (Pulse Code Modulation) dans lequel les échantillons sont codés de manière « brute » (aucune compression). Les logiciels d’édition sonore nécessitent également que les sons soient dans ce format pour pouvoir les éditer. Des logiciels comme Audacity permettent tout de même d’importer des fichiers mp3 qu’il reconvertit d’abord en Wave.

Complexité du problème

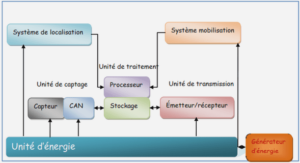

Pour appréhender le problème de reconnaissance automatique de la parole, il est bon d’en comprendre les différents niveaux de complexité et les différents facteurs qui en font un problème difficile. Le signal parole est des plus complexes, et sujet à beaucoup de variabilités. Ayant été produit par un système phonatoire humain complexe, il n’est pas facile de le caractériser à partir d’une simple représentation bidimensionnelle de propagation de sons. On peut distinguer certaines de ses caractéristiques comme les sons élémentaires ou phonèmes, la hauteur, le timbre, l’intensité, la vitesse… Mais en réalité, la voix est beaucoup plus complexe qu’on ne peut percevoir par l’oreille. L’onde sonore varie non seulement avec les sons prononcés, mais également avec les locuteurs. La très grande qui peut chanter, créer, murmurer, être enroué ou enrhumé, et aussi selon le locuteur luimême (homme, femme, enfant, voix nasillarde, différences de timbre), sans parler des accents régionaux, rend très délicate la définition d’invariants. Il faut pouvoir séparer ce qui caractérise les phonèmes, qui devrait être une constante quel que soit le locuteur et sa prononciation, de l’aspect particulier à chaque locuteur. Qu’est ce qui permet à notre cerveau de distinguer un mot d’un autre, indépendamment de celui qui nous parle ? De plus, la mesure du signal de parole est fortement influencée par la fonction de transfert du système de reconnaissance (les appareils d’acquisition et de transmission), ainsi que par le milieu ambiant. Ainsi l’obstacle majeur d’avoir une grande précision de la reconnaissance, est la grande variabilité des caractéristiques d’un signal vocal. Cette complexité du signal de parole provient de la combinaison de plusieurs facteurs, la redondance du signal acoustique, la grande variabilité inter et intra locuteur, les effets de la coarticulation en parole continue, et les conditions d’enregistrement.

La classification du son

Il existe deux grandes familles de son : le son analogique et le son numérique. Le son analogique est un signal électrique continu pour lequel il existe une valeur de tension en concordance avec la variation de la pression de l’air. Analogique vient du mot « analogue » ce qui signifie « ressemblance ». En effet, un son analogique est enregistré de façon analogue à l’onde sonore qu’elle produit. Un son est une pression d’air qui vibre en fonction du temps. Cette pression est captée par un microphone et transforme cette pression en tension. Le son numérique est représenté par une suite binaire de 0 et de 1. L’exemple le plus évident de son numérique est le CD audio Lorsqu’un son est enregistré à l’aide d’un microphone, les variations de pression acoustique sont transformées en une tension mesurable. Il s’agit d’une grandeur analogique continue représentée par une courbe variant en fonction du temps.

Un ordinateur ne sait gérer que des valeurs numériques discrètes. Il faut donc échantillonner le signal analogique pour convertir la tension en une suite de nombres qui seront traités par l’ordinateur. C’est le rôle du convertisseur analogique/numérique. Ainsi, la numérisation permet de transformer un signal sonore en fichier enregistré sur le disque dur de l’ordinateur, c’est le procédé permettant la construction d’une représentation discrète d’un objet du monde réel. Dans son sens le plus répandu, la numérisation est la conversion d’un signal audio en une suite de nombres permettant de représenter cet objet en informatique ou en électronique numérique. On utilise parfois le terme franglais digitalisation (digit signifiant chiffre en anglais).

|

Table des matières

Liste des figures

Introduction générale

Organisation du mémoire

Chapitre I : Généralités sur la reconnaissance vocale

1.Introduction

2.Historique

3.Définitions

3.1. La reconnaissance vocale

3.2 Le locuteur

3.3 Le son

3.3.1 Définition

3.3.2 Les sons simples et sons complexes

3.3.3 Les caractéristiques d’un son

3.3.4 La perception des sons

3.3.5 Le décibel

3.4 Le signal

3.5 Un fichier audio numérique :

3.Les avantages les plus importants de la reconnaissance vocale:

4.Les domaines d’application

5.1 L’État, l’armée et les renseignements

5.2 Le domaine professionnel

5.3 Le domaine personnel

6.Fonctionnement des logiciels de reconnaissance vocale

7.Complexité du problème

7.1 Redondance du signal de parole

7.2 Une grande variabilité

7.2.1 Variabilité intra-locuteur

7.2.2 Variabilité interlocuteur

7.3 La continuité

7.4 Le système est-il robuste ?

7.Approche de la reconnaissance

8.1 Approche globale

8.2 Approche analytique

9.La classification du son

10.Techniques de modulation

10.1 Modulation d’impulsions en amplitude (PAM)

10.2 Modulation d’impulsions en durée (PDM).

10.3 Modulation d’impulsions en position (PPM)

10.4 Modulation MIC différentielle (DPCM)

10.5 Modulation Delta (DM)

10.6 Modulation Delta adaptative ou à pente continuellement variable (CVSDM)

10.7 Modulation par impulsions codées (MIC)

11 Traitement du signal

11.1 Traitement du signal analogique

11.2 Traitement du signal Numérique

11.2.1 L’échantillonnage

11.2.2 La quantification

11.2.3 Le codage binaire:

12 Les modèles de la reconnaissance automatique

12.1 Modèle de langage

12.2 Modèle de prononciation

12.3 Modèle acoustique

13 L’analyse du signal

13.1 Comment est vue un signal13.2 La modélisation des paramètres acoustiques

13.3 Para métrisation du signal vocal

13.4 L’analyse de Fourier

13.5 Pourquoi l’échelle de Mel

14 Outils existants

14.1 HTK

14.2 Sphinx 4

15 Conclusion

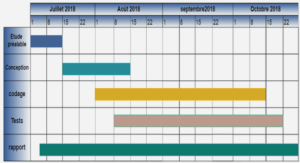

Chapitre II : Développement

1.Introduction

2.Définition du thème

2.1 Un jeu éducatif

2.2 Les avantages du jeu éducatif

2.3 Définition de l’Application

2.4 Le but de l’application

3.Reconnaissance vocale de Windows

4.Choix du langage de programmation

4.1 Qu’est-ce que le C#

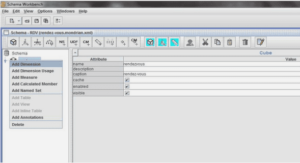

4.2 Qu’est-ce que SQLITE

Pourquoi utiliser SQLite

4.3 Qu’est-ce que UNITY ?

5.Modélisation

6.Quelque fenêtre de l’application

6.1 La fenêtre principale du logiciel

6.2 La partie de l’apprentissage

6.3 La phase des tests

6.4 La partie parents

6.5 Fenêtre nouveau examen

6.6 Fenêtre tester votre enfant

6.7 Fenêtre résultat

Conclusion

Conclusion Générale

Bibliographie

![]() Télécharger le rapport complet

Télécharger le rapport complet