Télécharger le fichier pdf d’un mémoire de fin d’études

Fonctionnalités et usages (potentiels) des systèmes d’IA de « nouvelle » génération

Dans notre recherche, nous nous intéressons aux différents systèmes d’IA de « nouvelle » génération qui disposent potentiellement de capacités d’évolution et d’amélioration de leur performance de manière automatique et/ou manuelle. L’objectif de cette partie est de préciser ce que sont – ou peuvent être – ces « nouveaux » systèmes d’IA du point de vue de leurs fonctionnalités et de leurs utilisations. Par fonctionnalités, nous entendons ce que ces systèmes sont capables de faire par conception. Nous présentons un panorama (synthétique et non exhaustif) des systèmes basés sur des algorithmes d’apprentissage.

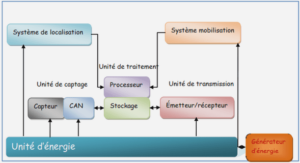

De nombreux secteurs d’activité sont concernés par la diffusion des systèmes d’IA, par exemple, l’industrie, la défense et la sécurité, la justice, l’éducation, la santé, la relation client, la finance, le transport, l’environnement, l’agriculture, ou encore les ressources humaines. Bien que ces systèmes aient été déployés dans certains environnements de travail, il semble que la plupart d’entre eux soient encore en phase de recherche et de prototype dans la plupart des secteurs professionnels, du moins en France. Les fonctionnalités de ces systèmes d’IA peuvent être présentées selon quatre types (Figure 1).

Le premier type de systèmes d’IA se limite aux systèmes de reconnaissance automatique d’éléments (par exemple, du texte, des sons, dans les images), d’aide à la recherche d’informations ou encore d’analyse automatique des données. Le deuxième type regroupe des systèmes plus sophistiqués capables d’effectuer des calculs de probabilités d’apparition d’événements et/ou de poser un diagnostic. Les systèmes du troisième type vont au-delà du diagnostic. En se basant sur leurs analyses des probabilités, ils peuvent proposer des choix d’action possibles à l’utilisateur ou recommander des « décisions ». Enfin, le quatrième type rassemble des systèmes qui sont capables de prendre une décision ou agir en partie de manière autonome sans intervention humaine mais toujours dans un cadre prédéfini ou supervisé. Illustrons ces types de fonctionnalités par des exemples concrets d’applications existantes ou imaginées dans différents secteurs professionnels.

Dans la relation client du domaine de la banque et assurance, les chargés de clientèle du Crédit Mutuel8 disposent d’un outil d’assistance basé sur le système Watson d’IBM9. L’objectif est de les aider dans la recherche d’informations dans leur base documentaire interne via un dialogue en langage « naturel ». Ici, nous avons donc un système d’IA avec le premier type de fonctionnalité qui se limite à la recherche d’informations pour apporter une réponse à une question posée, tout en identifiant la demande ou « l’intention » de l’utilisateur. Le système fonctionne comme un moteur de recherche sophistiqué qui est censé faciliter le travail des chargés de clientèle. D’autres systèmes, tels que les chatbots (considérés comme des agents conversationnels permettant aux utilisateurs de dialoguer en langage « naturel ») ou encore les systèmes à reconnaissance vocale (capables de reconnaitre, analyser la voix et transcrire automatiquement la parole en texte) font également partie de ce premier type de systèmes d’IA. Le deuxième type de fonctionnalités peut être illustré par les systèmes de maintenance prédictive/préventive. Il s’agit de calculer des risques de dysfonctionnements à venir ou d’estimer les pièces et les parties des machines qui nécessiteront dans un futur proche une maintenance. Plusieurs systèmes de ce type existent aujourd’hui sur le marché, déployés dans différents domaines comme le transport ou l’industrie. Par exemple, dans le domaine de la motorisation, Otosense10 propose un système permettant de faire une maintenance préventive à partir de l’analyse du bruit des moteurs. Le système est supposé permettre une réduction du temps d’arrêt des machines et des coûts de la maintenance, et éviter des accidents. Dans le domaine juridique, le système Predictice11 permet d’estimer le taux de succès d’une action contentieuse et les indemnités associées. Des systèmes dits prédictifs sont également proposés dans le domaine de l’agriculture. Par exemple, Microsoft, en partenariat avec The Yield12, propose un système d’IA qui donne aux agriculteurs des prévisions météorologiques micro-locales précises à partir d’une douzaine de facteurs (humidité des sols, vent, pluie, etc.) pour les aider à prendre des décisions (par exemple, de plantation). On retrouve également plusieurs applications de l’IA dans le domaine de la santé, comme la recherche médicale, la psychiatrie ou encore la radiologie. Pour ce qui concerne la radiologie, ce développement est notamment dû à l’amélioration des performances en reconnaissance et analyse des images. Par exemple, Milvue13 et Arterys14 développent des systèmes avec plusieurs algorithmes spécialisés pour analyser automatiquement des images radiologiques, réaliser des mesures sur celles-ci ou encore détecter des variations et des anomalies. Ainsi, le système peut par exemple détecter automatiquement une fracture, donc contribuer à établir un diagnostic. Par ailleurs, il peut aussi réaliser une priorisation des examens et ainsi recommander aux médecins les images radiologiques d’urgence à regarder et interpréter en premier. Cette dernière fonctionnalité de recommandation relèverait donc du troisième type des systèmes d’IA. Enfin, il existe également des outils d’assistance à base d’IA avec des fonctionnalités plus avancées de l’ordre de l’exécution, c’est-à-dire qu’ils peuvent en partie agir de manière « autonome », même si en réalité ils peuvent être supervisés par les humains. C’est le cas de l’assistant virtuel JulieDesk15 qui est capable de gérer un agenda comme envoyer des mails pour proposer des créneaux disponibles et ainsi organiser une réunion.

On peut donc constater qu’une grande variété d’applications de l’IA dans différents secteurs professionnels est proposée, même si la majorité des systèmes restent à l’état de prototype, de scénarios d’usage ou encore en phase de recherche. Pour recouvrir cette variabilité, il serait donc plus judicieux de parler de systèmes d’IA plutôt que de l’IA16 qui « occulte la multiplicité des dispositifs, des pratiques et des contextes d’usages » (Velkovska & Relieu, 2021, p. 221). Si une bonne partie des discours sur ces systèmes mettent l’accent sur les bénéfices attendus, par exemple en termes de performance économique, l’IA soulève toutefois un ensemble de questions relatives au travail que nous allons explorer dans la partie suivante.

Les enjeux soulevés par des systèmes d’IA dans les situations de travail

Le développement des systèmes d’IA et leur introduction potentielle dans les situations de travail ont été accompagnés de nombreux débats et réflexions sur la manière dont ces systèmes pourraient affecter le travail. Nous identifions deux grandes visions concernant ces effets potentiels : d’un côté, des promesses dans une perspective optimiste avec les nouvelles possibilités d’automatisation suscitées par l’IA et les avantages qu’elles représentent en termes de gain de temps et de productivité, et de l’autre côté, des craintes en termes de dangers que le développement et la diffusion massive des systèmes d’IA peut représenter pour l’humanité et notamment pour l’humain au travail. Ainsi, dans la littérature récente, majoritairement grise »17, les principales questions et conséquences discutées sont :

Les craintes de remplacement des humains par les machines et les transformations des activités et de l’organisation du travail,

La mise en place des systèmes d’IA qui implique une répartition des tâches entre les travailleurs et ces systèmes avec les différents apports et risques,

Les rapports de complémentarité entre les travailleurs et les systèmes d’IA,

Les démarches de conception et de mise en place des systèmes d’IA dans le travail.

Ces différents points sont abordés dans la suite de cette section.

Vers un « remplacement généralisé » des travailleurs ou une transformation du travail par les systèmes d’IA ?

Les craintes liées à l’IA sont tout d’abord fondées sur l’idée de l’automatisation des emplois et de dépassement des humains par les machines qui deviennent de plus en plus performantes. Les avancées technologiques se sont accompagnées par les incertitudes sur le futur de l’humanité sur lequel plusieurs personnalités se sont exprimées, comme Elon Musk ou encore Stephen Hawking, pour qui le développement de l’IA représenterait une menace pour nos sociétés (Deloitte, 2017). Dans cette réflexion, l’IA est vue comme une « super-intelligence » (Bostrom, 2014) qui dépasserait bientôt l’humain dans tous les domaines où il exerce son intelligence. Néanmoins, cette conception de l’IA est loin d’être « la réalité » aujourd’hui car comme nous avons pu voir, pour le moment, tous les systèmes d’IA sont de l’ordre d’une IA dite « faible », spécialisée dans la réalisation d’une tâche précise. En revanche, les interrogations sur le futur.

Il s’agit de rapports institutionnels et des cabinets privés, de livres blancs, etc. du travail avec l’arrivée de l’IA ne sont pas dépourvues de sens et méritent d’être discutées. Ces réflexions sont donc présentées dans cette partie.

Une nouvelle ère d’automatisation par l’IA

En effet, l’arrivée des nouveaux systèmes d’IA est associée à une nouvelle ère d’automatisation (Davenport & Kirby, 2015). L’automatisation peut se définir comme « l’exécution d’une fonction par une machine (généralement un ordinateur) qui était auparavant exécutée par un humain » (Parasuraman & Riley, 1997, p. 231). L’histoire de l’automatisation est plutôt ancienne et suivant les époques, le terme employé n’était pas le même. Il dépendait essentiellement de technologies utilisées pour réaliser diverses tâches réservées à l’humain. Si au début on parlait plutôt de la mécanisation, l’arrivée des technologies électroniques et numériques ont joué un grand rôle dans l’avancée des systèmes d’automatisation (COE, 2017). Trois grandes époques sont identifiées (Davenport & Kirby, 2015) durant lesquelles les domaines d’application de l’automatisation ont été élargis : la première du XIXème siècle, qui serait donc la mécanisation, où les machines prenaient le relais pour effectuer les tâches sales » et dangereuses ; la deuxième du XXème siècle, où avec l’arrivée du numérique les machines réalisaient des tâches répétitives et enfin, la troisième du XXIème siècle, où on voit arriver les machines « intelligentes » capables de produire des recommandations, voire prendre des décisions. Quand on parle de l’automatisation, il faut distinguer des systèmes automatisés et des systèmes autonomes (Moulieres-Seban, 2017). Les systèmes automatisés font face à des situations prévisibles car ils sont préprogrammés pour exécuter des opérations. Ils ne peuvent pas tenir compte de la situation et des événements imprévisibles pour se réadapter. Ils suivent des règles et des procédures préétablies indépendamment des événements qui peuvent survenir. Quant aux systèmes autonomes, ils peuvent faire face à des situations imprévues en s’adaptant aux événements et en optimisant leurs comportements pour atteindre leurs objectifs. Une distinction doit être également établie entre l’automatisation et les systèmes d’IA : les systèmes d’IA se présentent comme des moyens d’automatisation ce qui signifie que l’automatisation ne mobilise pas systématiquement les systèmes d’IA. Trappl (1985) décrivait déjà ce lien entre l’IA et l’automatisation dans les années 1980 et estimait que l’IA allait continuer de changer l’automatisation du travail.

Les craintes de l’automatisation massive des emplois

Ce sont alors les « nouvelles » possibilités d’automatisation du travail à travers les nouvelles performances des systèmes qui suscitent des craintes de disparition des emplois, un des enjeux majeurs pour les entreprises. Ces craintes sont liées au fait que « l’ampleur des destructions d’emplois par la technologie ne pourra être compensée par des créations » (Askenazy & Bach, 2019, p. 33), au moins temporairement. Les craintes liées à la disparition des emplois causée par l’automatisation ont toujours été l’objet d’un débat dans les différentes époques (Bradshaw et al., 2018). Une des études récentes la plus populaire sur la question d’automatisation des métiers est celle de Frey et Osborne (2013). Les auteurs ont estimé que 47% des emplois aux Etats-Unis avaient une forte possibilité d’être automatisés (par le biais des systèmes basés sur l’apprentissage). Cependant, c’est une étude controversée du fait de nombreuses limites qu’elle comporte. Il s’agit notamment de leur unité d’analyse située au niveau des métiers et non au niveau des tâches. Certaines tâches peuvent être effectivement automatisées dans un même métier, tandis qu’il est très difficile d’automatiser un métier dans son intégralité. Ainsi, des chercheurs allemands (Arntz et al., 2016) montrent que seulement 10% d’emplois ont un risque élevé d’automatisation lorsqu’on analyse les différentes tâches des métiers. Par ailleurs, la majorité des tâches (90%) vont plutôt évoluer que disparaitre complétement. Velkovska et Relieu (2021) évoquent également « que les interactions réelles sont bien loin des discours sur les agents artificiels comme porteurs de déshumanisation, qui seraient destinés à se substituer aux humains. » (pp. 222-223). En ce qui concerne la France, le COE18 montre aussi que moins de 10 % des emplois sont menacés de disparaitre et que le contenu va profondément changer pour environ la moitié des emplois existants (COE, 2017). Ainsi, l’hypothèse la plus probable sur laquelle il y a un consensus, c’est que la diffusion de l’IA s’accompagnerait non pas de la disparition des métiers mais par des transformations des métiers, des organisations et plus largement du travail.

Les transformations et évolutions des métiers et des organisations

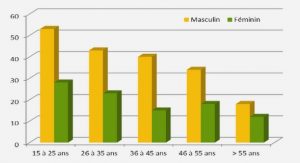

Certaines tâches et emplois auraient plus de risques d’être automatisés par les systèmes d’IA. C’est le cas pour des tâches structurées et prévisibles dans des emplois les moins qualifiés, même si les emplois qualifiés commencent à être de plus en plus concernés (Giblas et al., 2018). En revanche, on estime que les emplois « manuels » dans des environnements imprévisibles (les jardiniers, les plombiers…), devraient connaître des niveaux d’automatisation plus faibles, en raison par exemple du niveau de difficulté technique (Bradshaw et al., 2018). Ainsi, la nature des transformations serait liée au type d’emploi et de métier (Giblas et al., 2018) comme on peut le voir sur la Figure 2. Par exemple, cette figure indique que les opérateurs effectuant Le Conseil d’Orientation pour Emploi principalement des tâches administratives seraient susceptibles d’être substitués par les systèmes. Le travail des ouvriers pourrait être rendu moins pénible mais avec un risque de déqualification. D’autres métiers, comme des contrôleurs financiers ou des conseillers, pourraient être soutenus par les systèmes d’IA. Enfin, les artisans seraient peu impactés.

Pour certains, le développement des systèmes d’IA peut même être créateur d’emplois, voire il l’est déjà. Wilson et al. (2017) ont ainsi identifié l’émergence de trois nouvelles catégories de métiers : des « trainers », soient des entraineurs qui éduquent et apprennent aux algorithmes des subtilités du langage naturel mais aussi comment se montrer plus empathique dans leurs réponses ; des « sustainers », ce sont des personnes qui entretiennent, maintiennent et veillent sur le bon fonctionnement des systèmes d’IA, ils gèrent aussi des évènements imprévus, par exemple en surveillant un algorithme dans le respect de l’éthique ; des « explainers » dont le travail est d’expliquer pourquoi et comment un algorithme d’IA produit les résultats donnés. Ils doivent donc être capables d’expliquer le fonctionnement des systèmes d’IA et ce, de façon compréhensible pour des personnes sans connaissances techniques. La part importante de l’intervention humaine pour faire fonctionner ces systèmes, conduit Casilli (2019) à considérer l’IA comme étant faite à la main. Il est en effet à souligner que le travail d’étiquetage ou d’annotation des données d’apprentissage des algorithmes est à l’origine des nouveaux emplois précaires (Askenazy & Bach, 2019) du digital labor, soit un ensemble des « activités numériques quotidiennes des usagers des plateformes sociales, d’objets connectés ou d’applications mobiles » (Casilli, 2015, p. 13).

Les transformations futures du travail soulèvent également des questionnements dans les entreprises sur les nouvelles formes d’organisation. L’introduction des systèmes d’IA ne serait pas simplement un moyen technologique d’amélioration des processus de travail mais plutôt un moyen pour repenser l’organisation elle-même (Giblas et al., 2018). Ces futures organisations sont imaginées comme étant plus transparentes, moins hiérarchiques et plus coopératives grâce aux systèmes d’IA qui permettent l’exploitation de nombreuses données, mises à disposition aux différents acteurs de l’organisation avec l’objectif de guider leurs décisions. Ces systèmes sont donc supposés être « un facteur de partage vertical, en donnant à chaque niveau la visibilité sur l’ensemble des activités des différents niveaux de l’organisation, et horizontal en agrégeant les données des différentes entités de l’organisation » (Giblas et al., 2018, p. 40). Selon les auteurs, cela ferait émerger des nouvelles logiques de pouvoir, de partage d’informations et transformerait le rôle du management qui passerait du rôle de contrôle au rôle d’accompagnateur et d’animateur de l’équipe.

La mise en place et l’utilisation des systèmes d’IA dans les situations de travail : entre promesses et risques perçus

Les avantages de répartitions des tâches entre l’IA et les travailleurs

Aujourd’hui, l’un des avantages attendus des systèmes d’IA est qu’ils aideraient les travailleurs gagner du temps en automatisant les tâches « répétitives » (Giblas et al., 2018 ; McIntosh, 2018) et par conséquent à augmenter leurs performances (en termes de productivité) ou à se concentrer sur des tâches plus intéressantes. En supprimant ces tâches « répétitives », en donnant plus d’autonomie aux travailleurs dans les décisions et en les concentrant sur des aspects relationnels de leur travail considérés souvent comme tâches « à valeur ajoutées », « la machine va paradoxalement « remettre de l’humain dans le travail » » (Giblas et al., 2018, p. d’après certains dirigeants d’entreprise. Ferguson (2019) évoque un scénario de « l’employé réhumanisé » largement mobilisé dans les réflexions actuelles, par exemple dans le rapport de Villani (2018). Ce scénario renvoie à l’idée de « désautomatisation » en permettant à l’humain de développer des capacités complémentaires à l’IA. Toutefois, ces avantages hypothétiques dépendraient de la façon dont ces systèmes d’IA seraient déployés dans les organisations et de la fonction que l’on va leur attribuer.

Cela nous amène à nous interroger sur la place et le rôle de l’IA dans les situations de travail. Différentes approches spéculatives ont été proposées en ce sens. Par exemple, l’idée la plus répandue est le fait que les systèmes d’IA pourraient (ou devraient) prendre en charge des tâches routinières » tandis que les humains garderaient des tâches caractérisées par l’imprévisibilité ou encore nécessitant des compétences sociales (Bradshaw et al., 2018). Au lieu d’envisager des machines en tant que fournisseurs d’informations à l’humain pour l’aider dans la prise de décision, une autre approche propose que ce soit l’humain qui puisse fournir son jugement et son avis aux machines prenant des décisions (Mcafee & Brynjolfsson, 2017). De cette manière, les auteurs proposent de repenser le modèle de partenariat traditionnel entre l’humain et la machine, où les machines fournissent des données et les humains prennent des décisions. Ce changement de paradigme se justifierait par des performances grandissantes des machines et des capacités limitées de l’humain essentiellement sur le plan cognitif en termes de traitement de l’information. On délèguerait alors toutes les tâches automatisables aux machines en mettant l’humain hors de la boucle de décision, sauf dans des situations nouvelles et inhabituelles où l’humain aurait la possibilité de remettre en question les décisions de la machine.

Les risques et limites de la mise en place et de l’utilisation des systèmes d’IA Différents risques de la mise en place de l’IA sur le travail peuvent être soulevés : la polarisation ou la distinction renforcée des tâches à très forte ou très faible valeur ajoutée, la complexification des tâches pour l’humain ou encore la déqualification de certains travailleurs (Ferguson, 2019 ; Giblas et al., 2018). D’autres risques existeraient aussi au niveau de la santé au travail, par exemple le risque d’accroissement du contrôle des travailleurs par la machine qui impose le rythme et prescrit certaines tâches, ou encore le risque d’émergence des nouveaux gestes répétitifs dans le cas des robots à base d’IA. Enfin, une déshumanisation des relations de travail se présente comme le premier risque perçu par les salariés (Giblas et al., 2018). Cette deshumanisation consisterait à l’appauvrissement des interactions et liens sociaux (Ferguson, 2019), à la déqualification ou encore à la « déresponsabilisation »19 des travailleurs dont l’autonomie de prise de décision risque d’être remise en question et influencée par l’IA : « A mesure que se multiplieront les champs où l’IA prendra ou suggèrera une décision, la pression grandira sur l’opérateur pour se conformer à cette préconisation » (Giblas et al., 2018, p. 35). Officiellement, ces systèmes ont un rôle d’aide à la prise de décision mais les risques de « déresponsabilisation » sont bien réels, notamment dans le contexte où de plus en plus d’études, même si elles sont à nuancer, annoncent que l’IA aurait des performances supérieures à l’humain. Par exemple, il s’agit de performances en termes de rapidité dans l’analyse d’une grande quantité des données médicales ou encore en termes de précision dans la détection de diverses anomalies (Loh, 2018). « Dans le cas où ces annonces s’avéreraient exactes, il pourrait donc devenir hasardeux pour un médecin d’établir un diagnostic ou de faire un choix thérapeutique autre que celui recommandé par la machine, laquelle deviendrait dès lors le décideur effectif » (CNIL, 2017, p. 27). Ainsi, « quand l’IA décide, l’homme est moins autonome dans le pilotage de ses activités et sa prise de décision » (Ferguson, 2019, p. 30).

Quant au risque de la déqualification, il renvoie à une perte du savoir et de l’expertise humaine dans le cas où elle est confiée aux systèmes d’IA (Ferguson, 2019). Les craintes de perdre des compétences et de l’autonomie émergent alors chez les travailleurs, ce qui pourrait même les conduire à ne plus avoir confiance en leurs capacités. Face à ce fait, ce risque est souvent abordé sous l’angle de la nécessité du développement des compétences humaines, avec l’idée que l’humain devrait développer des compétences complémentaires de l’IA, celles dont les machines ne disposent pas encore (Villani, 2018). Certains soutiennent que le temps (supposé pouvoir être) libéré par l’automatisation de certaines tâches « routinières » devrait être consacré au développement des « softskills » (Lemberger et al., 2019) comme des compétences sociales et relationnelles ainsi que des capacités créatives et de précision. Cette approche est problématique si la complémentarité est principalement élaborée autour des capacités du système, l’humain étant considéré comme une « partie auxiliaire » qui doit s’adapter aux capacités de la machine. La réflexion doit également porter d’une part, sur les risques d’obsolescence de compétences de l’humain dont l’activité est transformée par l’arrivée de ces systèmes et d’autre part, sur le développement de nouvelles compétences nécessaires pour utiliser et travailler à l’aide des systèmes d’IA (Mateescu & Elish, 2018).

Les rapports entre les travailleurs et les systèmes d’IA dans une approche de complémentarité

Les rapports entre les travailleurs et les systèmes d’IA disposant de nouvelles performances améliorées20 constituent un point de réflexion dans les discours actuels, tout en mettant en avant les approches de la complémentarité. Cela fait fortement écho aux travaux précédents sur les relations entre les humains et les technologies. Effectivement, nombreuses sont les études, issues de plusieurs disciplines (par exemple, l’ergonomie, la sociologie, la psychologie, l’ingénierie etc.) et champs de recherche (par exemple, Interaction Homme-Machine (IHM) ou Human-Computer Interaction (HCI), Travail coopératif assisté par ordinateur ou Computer Supported Cooperative Work (CSCW) etc.), qui se sont intéressées aux relations entre les humains et les technologies de toute nature pour pouvoir les caractériser, les modéliser mais aussi agir sur les conditions de mise en place de ces relations ainsi que sur la conception des systèmes technologiques21.

Une perspective augmentative

Dans la littérature récente, l’IA est souvent considérée comme un outil qui peut et doit augmenter les capacités humaines (Daugherty & Wilson, 2018 ; Jarrahi, 2018). L’émergence du terme « collaborateur augmenté » (Giblas et al., 2018), décliné dans différents métiers, par exemple la radiologie pour parler de « radiologue augmenté » (Lincoln et al., 2019) est une bonne illustration de cette idée. En permettant aux travailleurs « de se concentrer sur des tâches à plus forte valeur cognitive et relationnelle » (Giblas et al., 2018, p. 25), l’IA contribuerait ainsi à maintenir les travailleurs opérationnels tout au long de leur carrière ainsi qu’à soutenir l’acquisition et le maintien de leurs compétences. Cette idée d’augmentation de l’humain par l’IA, qui est une idée ancienne prenant l’origine avec le concept de l’intelligence humaine augmentée des années 1960 (Engelbart, 1962), est donc très prisée par les entreprises, par les cabinets de conseil et sous-entend une augmentation de productivité.

Dans la conception de l’idée d’augmentation d’Engelbart (1962), les machines se présentent comme des éléments qui viennent accroitre des capacités intellectuelles de l’humain. Par exemple, en lui permettant d’avoir une meilleure compréhension et résolution des problèmes complexes, la machine ne va pas simplement pallier les déficiences humaines mais elle va plutôt augmenter les capacités humaines. Ainsi, on sort du paradigme d’un système de type prothèse dont l’objectif est de pallier les carences de l’humain, pour s’orienter davantage vers une perspective envisageant des outils en tant qu’instruments (Rabardel, 1995 ; Roth et al., 1987). Les auteurs montrent que la puissance des machines ne garantit pas la performance effective dans la réalisation d’une tâche impliquant les humains et les machines, notamment face à des situations inhabituelles. Pour cela, le rôle actif de l’humain, qui a besoin de comprendre l’état du système et du processus, demeure essentiel face à la variabilité des situations qui ne peuvent pas être anticipées par la machine. Il s’agit ici d’envisager une perspective instrumentale des technologies dans le sens où l’humain mobilise, utilise et adapte ces outils en tant que ressources pour la réalisation d’un objectif. Dans cette perspective, l’accent est mis sur l’utilisation des outils technologiques pour aider l’humain dans la réalisation d’une tâche plutôt que déléguer cette tâche à ces outils. La puissance d’un outil se manifeste en sa capacité à augmenter l’adaptabilité de l’humain aux différents types de problèmes qui peuvent survenir dans la poursuite de l’objectif.

A l’ère des systèmes d’IA, l’augmentation est envisagée dans une perspective mutuelle lorsque l’humain développe et entraîne ces systèmes (Daugherty & Wilson, 2018). Selon Daugherty et Wilson (2018), à terme, les métiers exigeant de la créativité, du leadership ou encore de l’empathie seront toujours réalisés par les humains. En revanche, les métiers avec des tâches répétitives et routinières seront effectués par des machines. Entre ces deux extrêmes, les auteurs imaginent l’existence d’un « intermédiaire » (missing middle) dans lequel il y aurait des activités « hybrides » réalisées par les humains et les machines qui s’augmentent mutuellement (Figure 3). Autrement dit, l’humain augmenterait la machine en l’entrainant avec des données massives, en donnant des explications sur ses actions et en veillant sur son bon fonctionnement. En retour, la machine pourrait aussi augmenter l’humain de trois façons : amplifier ses capacités cognitives, étendre ses capacités interactionnelles et l’augmenter physiquement en s’incorporant à lui. Dans cet espace « intermédiaire », les humains et les machines ne seraient plus des adversaires comme dans les approches substitutives mais plutôt des partenaires symbiotiques qui augmentent mutuellement leurs niveaux de performance.

Le rapport de stage ou le pfe est un document d’analyse, de synthèse et d’évaluation de votre apprentissage, c’est pour cela chatpfe.com propose le téléchargement des modèles complet de projet de fin d’étude, rapport de stage, mémoire, pfe, thèse, pour connaître la méthodologie à avoir et savoir comment construire les parties d’un projet de fin d’étude.

|

Table des matières

Introduction

Première partie : Contexte & Cadre d’analyse

Chapitre 1. Contexte et état de l’art

1.1. Intelligence Artificielle (IA) : de quoi parle-t-on ?

1.1.1. Éléments de définition de l’IA

1.1.2. Dimension historique et fonctionnement de l’IA

1.1.3. Fonctionnalités et usages (potentiels) des systèmes d’IA de « nouvelle » génération

1.2. Les enjeux soulevés par des systèmes d’IA dans les situations de travail

1.2.1. Vers un « remplacement généralisé » des travailleurs ou une transformation du travail par les systèmes d’IA ?

1.2.2. La mise en place et l’utilisation des systèmes d’IA dans les situations de travail : entre promesses et risques perçus

1.2.3. Les rapports entre les travailleurs et les systèmes d’IA dans une approche de complémentarité

1.2.4. Les processus de conception et les modalités d’intégration des systèmes d’IA dans les situations de travail

1.3. Synthèse et objectifs de recherche

Chapitre 2. Cadre d’analyse et démarche de recherche

2.1. Construction du cadre d’analyse

2.1.1. La mise en place des technologies et les incidences sur les activités de travail

2.1.2. Le problème d’explicabilité des systèmes et les enjeux de la confiance

2.1.3. Les usages dans les activités médiatisées par des artefacts

2.1.4. Le rôle des démarches de conception et de déploiement dans les usages des technologies

2.1.5. Synthèse du cadre d’analyse

2.2. Démarche de recherche

2.2.1. Les études empiriques et leurs objectifs

2.2.2. La démarche méthodologique globale

Deuxième partie : Contributions empiriques

Chapitre 3. Points de vue et expériences des acteurs de l’IA

3.1. Méthode : enquête qualitative

3.1.1. Démarche globale de l’enquête

3.1.2. Méthodes et outils de recueil des données

3.1.3. Population et déroulement du recueil des données

3.1.4. Traitement et analyse des données recueillies

3.2. Résultats

3.2.1. La compréhension, la conception et l’intégration des systèmes d’IA dans les situations de travail : démarches et leurs limites

3.2.2. La mise en place de l’IA et les transformations potentielles dans le travail

3.2.3. L’utilité de l’IA et les doutes sur des apports réels

3.2.4. Utiliser les systèmes d’IA : construire une confiance mais maintenir des capacités critiques

3.3. Discussion des résultats

3.3.1. La division du travail envisagée et les transformations potentielles du travail

3.3.2. Les apports potentiels mais mitigés des fonctionnalités de l’IA

3.3.3. Une vision technologique de la conception de l’IA

3.3.4. La construction de la confiance avec le maintien des capacités critiques envers l’IA

Chapitre 4. Usages effectifs des systèmes d’IA et leurs incidences dans le domaine de la radiologie

4.1. Contexte et méthode

4.1.1. La radiologie : un domaine particulièrement concerné par la diffusion des systèmes d’IA

4.1.2. Les cas de déploiement et d’usages des systèmes d’IA : méthodes et outils de recueil des données

4.1.3. Traitement et analyse des données recueillies

4.2. Résultats

4.2.1. L’IA comme « réponse » à l’augmentation de la charge de travail et manque de ressources humaines

4.2.2. La mise en place de la dictée à reconnaissance vocale et la réorganisation du travail

4.2.3. La mise en place du système de détection des fractures : un rôle « palliatif » des technologies

4.2.4. Les usages du système de dictée à reconnaissance vocale pour la production d’un compte-rendu et leurs incidences sur le travail

4.2.5. Les usages du système de détection des fractures dans l’activité d’interprétation des radiographies et leurs incidences sur le travail

4.3. Discussion des résultats

4.3.1. L’importance du contexte socio-organisationnel : des systèmes d’IA visant à pallier le manque de ressources dans le secteur hospitalier

4.3.2. L’organisation du travail et le rôle donné à l’IA : conséquences sur les activités, la fiabilité et la qualité du travail

4.3.3. Le travail d’adaptation et de recontextualisation face aux limites de l’IA : s’approprier l’IA pour la rendre bénéfique

Chapitre 5. Processus de conception et de déploiement d’un chatbot juridique

5.1. Contexte et méthode

5.1.1. La diffusion généralisée des chatbots : les systèmes d’IA les plus répandus

5.1.2. Le cas de la conception et du déploiement d’un chatbot juridique à base d’IA …

5.1.3. Méthodes, outils et déroulement du recueil des données

5.1.4. Traitement et analyse des données recueillies

5.2. Résultats

5.2.1. Le processus et les enjeux globaux de la conception et du déploiement du chatbot juridique

5.2.2. Un important travail de conception : le développement technique d’un chatbot fonctionnel

5.2.3. A la recherche des « besoins » des utilisateurs futurs : une source de préoccupations et de difficultés

5.2.4. L’inscription pérenne du chatbot dans les usages : optimisation, amélioration et évaluation

5.3. Discussion des résultats

5.3.1. Le chatbot juridique comme une « solution » face aux sollicitations récurrentes adressées aux juristes

5.3.2. Le « bricolage » comme un moyen d’appropriation d’un processus de conception émergent

5.3.3. Le travail humain de la conception du chatbot fonctionnel

5.3.4. La conception du chatbot guidée par des « besoins » projetés et identifiés

5.3.5. Les enjeux de pérennisation du chatbot dans les usages

Discussion générale & Perspectives de recherche

1. Évaluer la pertinence et l’adéquation de l’IA pour chaque situation de travail

2. Concevoir conjointement l’organisation du travail et les systèmes d’IA

3. Une double facette de l’IA

4. Place centrale de l’humain : favoriser le développement des capacités et du pouvoir d’agir soutenu par l’IA

5. Dépasser les écueils « classiques » des démarches de conception et de déploiement des systèmes d’IA

6. Vers des démarches de conception et de déploiement des systèmes d’IA centrées sur l’activité

6.1. Mobiliser une approche participative

6.2. Analyser le travail réel pour co-construire des scénarios d’usages potentiels et pertinents de l’IA

6.3. Analyser les incidences effectives ou potentielles de la mise en place et des usages de l’IA

6.4. Soutenir l’encapacitation : accompagner les travailleurs dans le développement des capacités critiques et du pouvoir de contrôle face à l’IA

7. Perspectives de recherche

Télécharger le rapport complet