Prétraitements nécessaires

Les algorithmes de fusion au niveau pixel exigent que les images sources soient rendues parfaitement superposables. Les images SPOT, Landsat, et ERS sont disponibles à différents niveaux de traitement, qui diffèrent en particulier par le système de projection adopté. On peut commander directement au distributeur, pour chaque capteur, des images géocodées c’est-à-dire projetées dans un repère cartographique. Cependant ces images ne sont pas corrigées des effets du relief, et le traitement capteur par capteur ne garantit pas une bonne superposabilité finale de toutes les images. Deux approches sont alors possibles : on peut recaler géométriquement les images par prise de points d’appui qui servent à l’estimation d’un modèle de déformation, souvent polynômial. La prise de points d’appui est généralement manuelle, mais des méthodes récentes permettent sous certaines hypothèses une sélection automatique (Djamdji et al. 1993). La géométrie finale est celle de l’une des images de départ, et ne correspond pas nécessairement à un repère cartographique. Cette approche est la plus simple à mettre en œuvre, mais elle n’est pas performante sur les régions comportant du relief, surtout en ce qui concerne l’image radar. C’est par ce moyen qu’ont été recalées les images SPOT P et XS de Barcelone et Toulouse traitées respectivement dans le chapitre 3 et l’annexe A, une approche plus élaborée est la création d’ortho-images à l’aide de données relatives à la position du capteur, et d’un modèle numérique de terrain (MNT) de la scène. Cette approche, parfois superflue pour des images optiques d’une zone à faible relief, est pratiquement indispensable pour le recalage optique-radar. Le principe en est décrit par exemple dans Tou tin et al. (1992). Une telle méthode a été adoptée pour la création des orthoimages SPOT, Landsat, et ERS sur Fos et Marignane (sud-est de la France), utilisées dans les chapitres 3, 4, et 5. Les images recalées sont généralement rééchantillonnées à un pas proche de leur résolution d’origine. Au delà de l’adoption d’une projection géométrique commune, il faut uniformiser le pas des différentes images pour obtenir une correspondance pixel à pixel. Les solutions classiques proposent un rééchantillonnage au pas le plus fin disponible dans le jeu d’images, généralement par plus proche voisin, ou par interpolation bilinéaire ou bicubique. Nous proposons alternativement une méthode originale qui, au lieu de rééchantillonner chaque image indépendamment, fusionne les images pour simuler un jeu d’images à la meilleure résolution disponible (cf. chap. 3). Un prétraitement souvent requis en fusion optique-radar est le filtrage du bruit de speckle de l’image radar. Le speckle peut être considéré comme un bruit ultiplicatif, décrit par exemple dans Elachi (1988)_ Pour les applications de fusion radiométrique (cf. chap. 4) ou de classification (cf. chap. 5) particulièrement, le speckle pollue le résultat de fusion. Nous appliquons dans ce cas un filtrage adapté, tel que l’algorithme proposé par Lopes et al. (1990). Par contre pour les applications qui exploitent les petites structures de l’image radar, comme la méthode de fusion décentralisée optique-radar décrite au chapitre 4, le filtrage du speckle est à proscrire car il altère ces structures.

Description de la méthode

Comme nous avons déjà mentionné, la méthode ARSIS extrait des informations sur les structures de l’image de meilleure résolution spatiale, pour les injecter dans chacune des images multispectrales de moins bonne résolution spatiale. Elle utilise pour cela l’analyse multirésolution et la transformée en ondelettes. L’analyse multirésolution (Ma!lat 1989) est un concept qui permet de décrire une image par ses approximations successives à des résolutions de plus en plus grossières. Elle consiste donc à extraire de l’image les structures dont les fréquences spatiales sont contenues dans un intervalle donné. Son avantage sur les outils descriptifs que sont la transformée de Fourier ou les variogrammes (fonctions de structures) est de conserver la localisation spatiale des structures décrites. La transformée en ondelettes permet de modéliser la différence d’information entre deux approximations successives de cette analyse multirésolution. On peut ensuite effectuer une reconstruction parfaite de l’image initiale, à partir de ses approximations successives et des coefficients d’ondelettes. La méthode ARSIS s’applique à un couple d’images de résolutions spatiales différentes ; nous noterons respectivement HR l’image de meilleure résolution et BR l’image de moins bonne résolution, et RHR et RBR leurs résolutions respectives. Le concept d’analyse multirésolution, qui permet de décrire chacune de ces images, peut être illustré par une pyramide. A la base de la pyramide se trouve l’image initiale, et l’on dispose de ses approximations à des résolutions de plus en plus grossières au fur et à mesure que l’on gravit la pyramide. Au sommet, l’approximation se réduit à un unique pixel. Les pyramides représentant respectivement les images HR et BR sont représentées sur la figure 3.1. La longueur du côté de leurs bases respectives diffère dans un rapport égal au rapport de leurs résolutions spatiales. Nous considérerons dans un premier temps le cas où ce rapport de résolutions est égal à 2, ce qui permet l’utilisation d’une ondelette dyadique. Dans ce cas, les résolutions successives d’une même pyramide (correspondants aux « étages ») sont dans un rapport 2. Le but de la méthode est de prolonger la pyramide BR en utilisant l’information de la pyramide HR. On va pour ce faire utiliser les coefficients d’ondelettes contenant l’information sur les structures d’échelles comprises entre les résolutions RHR et RBR· La méthode ARSIS va donc injecter dans l’image BR uniquement des structures manquantes aux petites échelles, sans modifier les autres structures déjà présentes.

Influence de la fonction de transfert de l’instrument et des effets atmosphériques

Nous avons identifié deux problèmes affectant la synthèse des images multispectrales à haute résolution spatiale : la fonction de transfert optique de l’instrument d’une part, et les effets atmosphériques d’autre part. La fonction de transfert optique caractérise la réponse « géométrique » (donc la résolution spatiale) d’un instrument optique pour chaque bande spectrale. Les structures déduites de 1 ‘image HR par une transformée en ondelettes sont donc affectées des effets de la fonction de transfert de HR, qu’elles transmettent via le modèle à l’image synthétisée BR+. Nous n’avons pas pu estimer l’influence de cette fonction de transfert sur l’image BR+. En effet, les calculs mathématiques sont complexes et ne peuvent être simplifiés, car les fréquences spatiales de la fonction de transfert et de l’ondelette analysante sont similaires. L’application d’ARSIS à différents capteurs comme SPOT P et XS, ou SPOT Pet Landsat TM, ou Landsat TM (30 rn) et TM6 (120 rn), donne des résultats relativement proches, ce qui semble indiquer que la fonction de transfert ne joue pas un rôle prédominant dans la synthèse de l’image BR+. Les images HR et BR fusionnées par la méthode ARSIS sont toutes deux sujettes aux effets atmosphériques, lesquels sont spécifiques à chaque bande spectrale. Il est donc légitime de se demander si les structures extraites de l’image HR, au niveau satellite, ne vont pas entacher l’image synthétisée BR+ des effets atmosphériques propres à la bande HR. Nous examinons d’une part l’influence de l’atmosphère sur les structures de l’image HR, et d’autre part le comportement du modèle d’ARSIS qui en déduit les structures à réinjecter dans l’image BR.

Résultats visuels

Afin de montrer l’apport visuel de la méthode ARSIS, nous présentons des images localisées sur la vignette n°2 de Barcelone (cf. fig. 3.6). Cette zone est particulièrement riche en petites structures, tant sur la partie urbaine que sur les infrastructures portuaires. C’est pourquoi elle a été préférée à la vignette n° 1 pour mettre en valeur l’accroissement de résolution spatiale apporté par la méthode ARSIS. La figure 3.7 représente la vignette n°2 extraite de l’image panchromatique, et les figures 3.8 et 3.9 les compositions colorées effectuées respectivement sur les images XS et XS-HR correspondantes. Un grossissement d’une petite partie du port est présenté sous chaque image dont il est tiré, pour mieux mettre en évidence les différences de qualité géométrique. L’image XS a été ramenée à la même taille que les deux autres, pour faciliter leur comparaison, par une duplication de pixels qui n’en modifie pas les couleurs. Les compositions colorées affectent classiquement XS 1 au canal bleu, XS2 au vert, et XS3 au rouge. Les tables de transcodage, servant à adapter la dynamique de chaque bande au restituteur, sont identiques pour les images XS et XS-HR, afin de permettre leur comparaison. On constate que les couleurs sont semblables sur les compositions colorées XS et XS-HR, ce qui traduit que les images XS-HR sont radiométriquement très proches des images XS d’origine. L’apport d’ARSIS en petites structures est notable sur l’ensemble de la vignette ; il est en particulier très net sur les infrastructures du port dont certaines sont discernables sur XS-HR et non sur XS. Cette remarque s’applique également à la zone urbaine, qui comporte beaucoup de structures d’échelles 10-20 m.

VALIDITE DE L’ESTIMATION DE LA QUALITE

Afin d’estimer quantitativement la qualité radiométrique des images synthétisées par ARSIS, il est nécessaire de posséder une image de référence à laquelle comparer l’image estimée. Dans le cas de SPOT par exemple, on ne dispose bien évidemment pas d’images multispectrales de résolution 10 rn pour évaluer la qualité des images XS-HR. Nous avons donc décidé de translater les traitements d’un facteur 2 en résolution, et de comparer les images estimées XS*, de résolution 20 rn, aux images de référence XS. On ne peut cependant pas en déduire que les images estimées XS-HR, de résolution 10 rn, possèdent la même qualité que les images XS*. Intuitivement, l’erreur de modélisation d’un objet croît lorsqu’on affine la résolution, sauf si l’objet possède une structure caractéristique d’échelles supérieures à la résolution. Pourtant, des travaux récents, théoriques comme ceux de Raffy (1993) ou d’analyse de mesures satellitaires, comme ceux de Welch et al. (1989) Kong, Vidal-Madjar (1988), ou Woodcock, Strahler (1987) ont montré que l’estimation d’un paramètre est une fonction non prédictible de l’échelle d’observation et également des types d’objets observés. Il s’ensuit qu’il est difficile de déduire la qualité des images XS-HR (10 rn) de la qualité mesurée sur les images XS* (20 rn). La première peut être meilleure ou moins bonne que la dernière, car la qualité de l’estimée n’est pas nécessairement une fonction monotone de la résolution. Pour illustrer ce propos, voici l’erreur commise sur une image XS1*, estimée à 20 rn à partir d’une image XS 1 à 40 rn, comparée à celle d’une image notée XS140*, estimée à 40 rn à partir d’une image XS1 à 80 m. Les images Pet XS1 utilisées correspondent à la vignette n° 1 de Barcelone (cf. fig. 3.6), assez riche en petites structures. Les résultats sont présentés par les tableaux 3.8 et 3.9.

|

Table des matières

Chapitre 1: INTRODUCTION

Chapitre 2: DONNEES UTILISEES ET ASPECTS DE FUSION ABORDES

2.1 INTRODUCTION

2.2 DONNEES UTILISEES

2.2.1 Un choix limité

2.2.2 Les capteurs retenus

2.2.3 Prétraitements nécessaires

2.3 DIFFERENTS NIVEAUX DE FUSION ET METIIODES ASSOCIEES

2.4 FORMALISME DE FUSION ADOPTE

Chapitre 3: UNE SOLUTION A LA FUSION MULTIRESOLUTION: LA METHODE ARSIS

3.1 INTRODUCTION

3.2 DESCRIPTION DE LA METHODE ARSIS

3.2.1 Prétraitements et hypothèses

3.2.2 Description de la méthode

3.2.3 Influence de la fonction de transfert de l’instrument et des effets atmosphériques

3.3 APPLICATION A LA FUSION SPOT P+XS

3.3.1 Introduction

3.3.2 Résultats numériques

3.3.3 Résultats visuels

3.3.4 Conclusion

3.4 APPLICATION A L’ESTIMATION DE L’INDICE DE VEGETATION

3.4.1 Définition du NDVI

3.4.2 Mise en œuvre d’ARSIS

3.5 APPLICATION A D’AUTRES RAPPORTS DE RESOLUTION

3.6 VALIDITE DE L’ESTIMATION DE LA QUALITE

3.7 CONCLUSION

Chapitre 4: PRESENTATION VISUELLE DU VOLUME DE DONNEES

4.1 INTRODUCTION

4.2 CHANGEMENT D’ESPACE DE REPRESENTATION

4.3 UNE METHODE DE FUSION D’IMAGES OPTIQUE ET RADAR

4.4 CONCLUSION

Chapitre 5: CLASSIFICATION· ANALYSE DE DIFFERENTES ARCHITECTURES DE FUSION

5.1 INTRODUCTION

5.2 CLASSIFICATION D’IMAGES

5.2.1 Choix des classificateurs

5.2.2 Capteurs disponibles et classes choisies

5.2.3 Sélection des données d’apprentissage et des données test

5.2.4 Critères d’évaluation de la qualité des classifications

5.2.5 Prétraitements des images

5.2.5.1 Filtrage du speckle

5.2.5.2 Texture

5.3 DIFFERENTES ARCHITECTURES DE FUSION POUR LA CLASSIFICATION

5.3.1 Généralités

5.3.2 Architecture centralisée

5.3.3 Architecture décentralisée

5.3.4 Architecture mixte

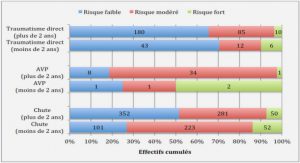

5.4 ANALYSE DES RESULTATS

5.4.1 Introduction

5.4.2 Classification sur SPOT, ERS-!, et Landsat

5.4.2.1 Classifications monocapteurs

5.4.2.2 Architecture centralisée

5.4.2.3 Architecture décentralisée

5.4.2.4 Architecture mixte

5.4.3 Classification sur SPOT et ERS-1

5.4.4 Classification sur SPOT bruité et ERS-!

5.4.5 Synthèse des résultats

5.5 CONCLUSION

Chapitre 6: CONCLUSION

REFERENCES BIBLIOGRAPHIQUES

ANNEXES

![]() Télécharger le rapport complet

Télécharger le rapport complet