La consommation d’énergie dans le Cloud Computing

Cloud Computing

Le Cloud Computing est un service généralement employé par l’internet que nous utilisons presque tous les jours sans nous rendre compte de l’envoie des emails au stockage de nos données. Ces services se sont vite développés grâce à l’évolution rapide de l’internet et son installation quasi-totale dans le monde. Ce 1er chapitre est entièrement consacré pour avoir une vue générale sur le Cloud et comment bien le maitriser.

Le Cloud voulant dire un Nuage en anglais, donc il peut être appelé aussi un nuage de données en informatique, de manière générale. On parle de Cloud Computing lorsqu’il est possible d’accéder à des données ou à des programmes, tels que le calcul, l’Access et stockage de données à des endroits inconnus depuis l’internet, plutôt que via le disque dur d’un ordinateur. Il s’oppose ainsi à la notion de stockage local, consistant à entreposer des données ou à lancer des programmes depuis le disque dur, ou tout du moins lorsque ces données sont synchronisées avec d’autres informations sur internet. Il suffit donc pour y’accéder de bénéficier d’une connexion internet. [2] L’arrivée du Cloud Computing révolutionne l’utilisation des services informatiques des entreprises.

Aujourd’hui, les entreprises doivent gérer leur parc informatique et les contraintes de consommation/maintenance qui y sont liées. Désormais, avec le Cloud Computing, les entreprises peuvent utiliser à la demande les services informatiques, sans se soucier des problématiques d’infrastructure, de sécurité et de maintenance. Les caractéristiques majeures du Cloud se reflètent dans l’accès en libre-service à la demande, un accès ubiquitaire au réseau, une mise en commun des ressources et une élasticité rapide, un service mesuré en permanence. [3] Cette technologie a pour but d’offrir plusieurs avantages, comme par exemple l’approvisionnement en libre-service, ou ce que nous pouvons appeler mobilité permettant aux utilisateurs d’accéder à n’importe quel service informatique à la demande. Ensuite il y’a l’élasticité qui a pour but de réduire la consommation de ressources en fonction des besoins de l’entreprise. Enfin il y’a la réduction des coûts puisque les utilisateurs ne payent que ce qu’ils consomment.

La consommation d’énergie dans le Cloud Computing

Dans le chapitre présent nous allons focaliser nos recherches sur la consommation d’énergie du Cloud Computing, qui est une des plus grandes préoccupations de nos jours par apport à son grand impact sur notre environnement. Et c’est à cause de l’augmentation de l’effet de serre, qui provoque une pollution atmosphérique causant un réchauffement climatique qui risque ainsi d’élever le niveau des mers, inonder les zones côtières basses, et certaines îles en plus de menacer l’existence de certaines espèces animales. Comme dans chaque secteur, nous trouvons des groupes et associations dont leur but est de veiller sur la protection de l’environnement. Dans le domaine informatique, nous avons le GreenIT, dont sa préoccupation majeure est de veiller à diminuer la consommation d’énergie tout en gardant la même qualité de service. Avant l’apparition du Cloud Computing, chaque entreprise avait besoin d’avoir son propre data center où sont regroupés plusieurs équipements informatiques tels que serveurs, baies de stockage, ordinateurs centraux etc. Et dans la majorité des cas ils exploitaient à peine 50% des besoins de ces data center, et par conséquence ils engendrent une forte consommation d’énergie pour des besoins limités. Depuis l’apparition du Cloud Computing, les entreprises et particuliers ont commencé à louer ces services qui sont peu coûteux par rapport aux prix d’installation de leur propre data center et avec la même efficacité. Les acteurs principaux du Cloud ont pour but et objectif de fournir ces services à leurs clients afin d’augmenter leurs revenus, tout en consommant le plus efficacement l’énergie utilisé par leurs infrastructures.

L’impact sur le Cloud Computing

L’évolution des Data Centers ces dernières décennies est nettement considérable, on estime même que le marché va progresser de 5% par an pour atteindre 152 milliards dans un futur proche. Au même temps, la tendance ces dernières années est dans la construction de méga-center avec des capacités qui dépasse les 40 Mw qui consomment une quantité énorme d’énergie. Pour cela, l’efficacité énergétique est devenue un enjeu de taille dans les centres de données pour le respect de l’environnement et minimiser les coûts de la consommation énergétique tout en optimisant les performances de fonctionnement des Data Center. [15] Après une étude faite en 2011, ils ont trouvé que le Cloud était l’un des plus gros consommateurs d’électricité dans le monde, puisqu’il a consommé plus de 15×1013 Watts/heure, tout cela en seulement une année. Grace à un rapport de Digital Power Group, nous avons su aussi que si le Cloud était un pays, il serait dans le top 10 des consommateurs mondiaux d’électricité, devant même l’Inde, l’Allemagne ou même la France, comme nous pouvons le voir sur cette photo Pour avoir une idée ce que peut représenter cette consommation, prenons comme exemple la France où les 130 data centers, principalement situés en région parisienne, absorbent aujourd’hui 9% de l’électricité du pays. « En moyenne, un data center utilise aujourd’hui en permanence environ 2 kilowatts par mètre carré. Sur 500 m2, c’est 1 MW consommé en continu, soit annuellement l’équivalent de l’énergie électrique utilisée par plus de 1.000 foyers », précise Ghislain Colom, directeur Data Center Solutions de Cofely Services, filiale du groupe Engie.

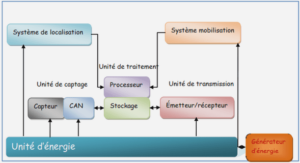

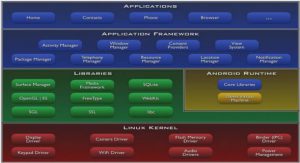

Le coût généré par l’exploitation d’un data center est important, pouvant devenir rapidement important puisqu’alimenter un data center en électricité en plusieurs années est équivalent à acheter un data center neuve. Donc que ce soit pour des raisons économiques, environnemental, ou simplement pratiques, c’est une obligation de réduire cette consommation énergétique des Cloud. Dans notre présentation du Cloud, nous avons su que la structure du Cloud est composée de 2 parties le BACK END et le FRONT END. Nous allons concentrer nos recherches sur le BACK END car c’est la partie qui peut être contrôlée par les propriétaires des centres du Cloud, mais nous avons tout de même fait quelques recherches sur la partie FRONT END et essayer de proposer des solutions pour la réduire à son tour.

Les manières de réduire la consommation d’énergie dans les Data Centers

Vu l’omniprésence de l’écologie dans le monde d’aujourd’hui dans tous les domaines, même l’informatique s’est convertit à l’écologie, dans un concept qu’ils ont appelé le « Green Computing ». Et donc, même le Cloud s’est convertit à ce concept puisque la grande consommation d’énergie que consomment ces derniers est énorme ce qui signifie la non adoption au concept écologique. Pour cela des grands noms de l’informatique tel que HP, DELL ou même IBM se sont investi à créer des produits économes. Nous prenons comme exemple l’Insight Power Manager de HP qui a pour but de limiter la consommation des Data Centers en adaptant la vitesse d’horloge des processus à la charge voulu. Aussi le Smart Cooling qui a pour but de réguler la puissance des systèmes de climatisation en fonction des températures mesurées. [15] Olivier Seznec (ancien directeur d’innovation France, Cisco en 2012), propose la virtualisation qui a pour but de réduire le nombre de serveur sur une même machine nous ferons tourner plusieurs serveurs logiques, c’est-à-dire sur un seul serveur physique on fait tourner plusieurs serveurs logiques, et cela revient le mérite aux machines multicoeurs qui peuvent exister de nos jours, et qui peuvent supporter 80% de serveurs logiques. Ensuite il propose l’automatisation, en faisant augmenter la puissance de calcul à une demande réelle, et cela en faisant désinstaller les serveurs et les machines qui commencent à tourner à vide et consommer pour rien, coté Data Center, nous ferons éteindre les machines physiques associées. )

propose aussi l’optimisation des câblages, en faisant référence aux années précédentes où il y avait un câblage spécifique pour chaque procédure (stockage, calcul et réseau(etc.)), donc standardiser le câblage pour enfin avoir un câblage universel et cela poussera à économiser jusqu’à 70% de câblage, tout en faisant augmenter le débit car tout sera concentré et destiné à un seul câble. [20] Cette virtualisation peut être nommée aussi mutualisation des serveurs. Les gestionnaires de Data Center citent. « On mutualise sur une seule machine plusieurs serveurs, leur alimentation électrique, et leur dissipation de chaleur. Le refroidissement, le routage et l’accès au réseau sont alors réduits », explique le Syntec. « Héberger les serveurs de 300 clients dans nos trois data centers en région parisienne [représentant une surface totale d’environ 7.000 m2, ndlr] divise leur consommation totale par deux », a fait valoir M. Duproz. « Le fait que les clients viennent chez nous est un gain en impact carbone colossal. Un kilowatt consommé dans un data center, c’est environ 4 à 5 kilowatts qui ne sont pas consommés ailleurs ! », affirme-t-il. En plus de la maintenance, « nous réalisons, au jour le jour, les meilleurs réglages pour avoir la meilleure performance de l’installation.

En complément, nous pouvons proposer des opérations de modification ou de rénovation. Nous sommes ainsi capables de faire réaliser 10% d’économies d’énergie voire plus sur une installation, selon son ancienneté et le niveau d’investissement du client », ajoute de son côté Ghislain Colom de Cofely Services. Le groupe exploite 70 data centers en France, représentant près de 140.000 m2 (partie informatique) soit un quart du marché français, et 500.000 m2 en Europe. Il a acquis en juillet dernier Apis Engineering, un bureau d’études techniques spécialisé dans la conception et la rénovation des centres informatiques.

|

Table des matières

Chapitre 1 Introduction au Cloud Computing (généralité)

1.Introduction

2.Définition

3.Historique

4.Les composantes principales du Cloud

5.L’architecture du cloud computing

5.1 THE FRONT END

5.2 THE BACK END

6.Les caractéristiques du cloud computing

7.Les Types

7.1 SAAS

7.2 PAAS

7.3 IAAS

8.Modèles de déploiements

8.1 Le Cloud Public

8.2 Le Cloud Privé

8.3 Le Cloud Hybride

8.4 Le Cloud Communautaire

9.Avantages du Cloud Computing

10.Inconvénients du Cloud Computing

Conclusion

Chapitre 2 La consommation d’énergie dans le Cloud Computing

1.Introduction

2.Définition de la consommation d’énergie

3.Paramètre de calcul de la consommation énergétique

4.L’impacte sur le Cloud Computing

4.1 Partie FRONT END

4.2 Partie BACK END

5.Raisons de la consommation d’énergie des Data Centers

6.Manières de réduire la consommation d’énergie dans les Data Centers

7.La virtualisation

7.1 Emulation

7.2 Virtualisation complète

7.3 Paravirtualisation

8.L’hyperviseur

9.La méthode ON/OFF

10.Le mécanisme de Migration

10.1 Migration a froid (Stop and copy migration)

10.2 Migration a chaud (live migration)

10.3 Les Avantages de la Virtualisation

11.Les inconvénients de la Virtualisation

12.Les Avantages de la migration

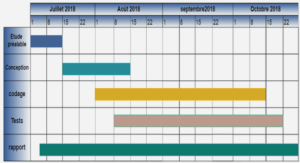

13.Introduction à l’aspect pratique

14.1 NonPowerAware

14.2 DVFS (Dynamic voltage and frequency scaling)

14.3 LrMu (Local Regression Minimum Utilization)

Conclusion

Chapitre 3 Implémentation et résultats des approches proposées pour la réduction de la consommation d’énergie

1.Introduction

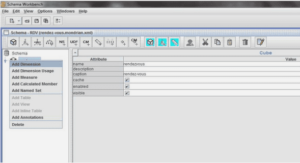

2.Langage et environnement de développement

2.1 Langage de programmation java

2.2 Environnement de développement

2.3 Simulateur Cloud Sim

3.Simulation des approches proposés

4.Fonctionnements communs des algorithmes

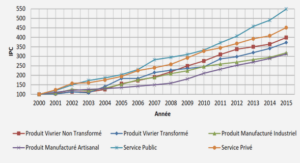

5.Comparative des résultats des 3 algorithmes par apport à la consommation d’énergie totale

6.Etude de la consommation partielle pour chaque algorithme

6.1 NonPowerAware

6.2 DVFS

6.3 LrMu

6.4 Déduction

7.Etude de la consommation par hôte pour chaque algorithme

7.1 NonPowerAware

7.2 DVFS.java

7.3 LrMu

7.4 déduction

Conclusion

Conclusion générale

![]() Télécharger le rapport complet

Télécharger le rapport complet