La configuration d’ OpenCV avec Visual Studio

Notion de base sur les images et les vidéos

Introduction

Le traitement des vidéo est spécialistes de différents manipulation de ces données une science récente qui a pour but d’offrir aux domaines, comme augrand public, des outils de digitales issues du monde réel.

Dans ce chapitre, nous allons présenter les différentes phases de la formation de vidéo ainsi que sa définition, de ces différents types, ed ces caractéristiques et de ces formats .

L’image et sa représentation

L’image est définie comme étant une fonction f(x, )y à deux dimensions, où x et y sont les coordonnées spatiales, et l’amplitude à tous points f(x, y) correspondant à l’intensité ou au niveau de gris. Lorsque les points (x, y) et l’amplitude sont discrétisés, on parle d’image numérique ou digitale. Dans ce dernier cas la fonction f est remplacée par la lettre I et le couple (x, y) par le couple (i, j).L’image numérique, désignée aussi par le terme scène, possède un repère comme indiqué Figure II.1, il est différent de celui d’une fonction mathématique. Elle a une hauteur (H) et une largeur (W).

Types d’images

Les images peuvent être en plusieurs types :

Image binaire

Une image binaire est une matrice rectangulaire dont les éléments valent 0 ou 1. Lorsque l’on visualise une telle image, les zéros sont représentés par des noirs et les une par des blancs. [2]

Image en niveau de gris

Chaque pixel est un niveau de gris, allant de 0 (noir) à 255 (blanc). Cet intervalle de valeur signifie que chaque pixel est codé sur huit bits (un octet). 256 niveaux de gris suffisent pour la reconnaissance de la plus part des objets d’une scène. [S11]

Codage d’une image en niveaux de gris

Si on code chaque pixel sur 2 bits on aura 4 possibilités (noir, gris foncé, gris clair, blanc). L’image codée sera très peu nuancée.

En général on code chaque pixel sur 8 bits = 1 octe. On a alors 256 possibilités (on dit 256 niveaux de gris).

L’image de 10 000 pixels codée occupe alors 10 000octets en mémoire.

Exemple d’image en 72 pixels par pouce (environ 30 pixels par cm), codée en 256 niveaux de gris.

Cette image de 303 x 303 pixels occupe 303 x 303 = 91809 octets puisque chaque pixel occupe 1 octet en mémoire.[S11]

Image couleur (RGB)

Chaque pixel possède une couleur décrite par la quantité de rouge (R), vert (G) et bleu (B).

Chacune de ces trois composantes est codée sur l’intervalle [0, 255], ce qui donne 2553=16 777 216 couleurs possibles. Il faut 24 bits pour coder un pixel. [S11]

Codage d’une image en couleurs 8 bits

Dans ce cas on attache une palette de 256 couleurs à l’image.

Ces 256 couleurs sont choisies parmi les 16 millions de couleurs de la palette RVB. Pour chaque image le programme recherche les 256 couleurs les plus pertinentes. Chaque code (de 0 à 255) désigne une couleur.

L’image occupe 3 fois moins de place en mémoire qu’avec un codage 24 bits. L’image est moins nuancée : sa qualité est bonne mais moindre[S11].

Codage d’une image en couleurs 24 bits

Il existe plusieurs modes de codage de la couleur. Le plus utilisé est le codage Rouge, Vert, Bleu (RVB). Chaque couleur est codée sur 1 octet = 8 bits. Chaque pixel sur 3 octets c’est à dire 24 bits : le rouge de 0 à 255, le vert de 0 à 255, le Bleu de 0 à 255.

Le principe repose sur la synthèse additive des couleurs : on peut obtenir une couleur quelconque par addition de ces 3 couleurs primaires en proportions convenables.

On obtient ainsi 256 x 256 x 256 = 16777216 (plus de 16 millions de couleurs différentes).[S11]

Caractéristiques de l’image

Pixel

Une image est constituée d’un ensemble de points appelés pixels (voir l’extrait de la figure II.1). Le pixel (Picture élément) représente ainsi le lusp petit élément constitutif d’une image numérique. La quantité d’information que véhicule chaque pixel donne des nuances entre images monochromes et images couleurs. Pour les images 3D le «pixel» est alors appelé un voxel, et représente un volumeélémentaire. Des exemples d’images de ce type se rencontrent dans les images médicales. Les images tomographiques axiales sont ainsi des images construites à partir de plusi eurs radiographies faites sous des angles de vue différents .[S20]

Poids de l’image

C’est la taille de l’image. Etant donné que cette dernière est représentée sous forme d’une matrice dont les valeurs représentent l’intensité pixels),( le nombre de colonne (W) multiplié par le nombre de ligne (H) donne le nombre total de pixels dans l’image.

Pour une image de 640×480 en couleur :

Nombre de pixel = 640×480 = 307200

Poids de chaque pixel = 3 octets

Le poids de l’image = 307200×3 = 921600 octets = 900 Ko. [S7]

Bruit

Un bruit (parasite) dans une image est considéré comme un phénomène de brusque variation de l’intensité d’un pixel par rapport à ses voisins, il provient de l’éclairage des dispositifs optiques et électroniques du capteur.[3]

Transparence

La transparence est une caractéristique définissantle niveau d’opacité des éléments de L’image, c’est la possibilité de voir à travers l’i mage des éléments graphiques situés derrière celle-ci. [S21]

Luminance

C’est le degré de luminosité des points de l’image.Elle est définie ainsi comme étant le quotient de l’intensité lumineuse d’une surface par l’aire apparente de cette surface. [24]

Contraste

Est une propriété intrinsèque d’une image qui désigne et quantifie la différence entre les parties claires et foncées d’une image (elle différencie les couleurs claires des couleurs foncées).

En photographie on le définit le contraste comme la différence entre la densité la plus forte et la plus faible d’une image. Le contrôle du contraste est un élément important de la pratique photographique. Le contraste final de l’image dépend à la fois du sujet, de la nature et du traitement du négatif et du positif.[S22]

Histogramme

Un histogramme est un graphique statistique permettant de représenter la distribution des intensités des pixels d’une image. Il fournit diverses informations comme les statistiques d’ordre (moyenne, variance,…), l’entropie, et peut permettre d’isoler des objets. [S8]

Figure II.2 : Exemple d’image en niveaux de gris. [S9]

Pour les images en couleur plusieurs histogrammes sont nécessaires.

Par exemple pour une image codée en RGB:

• un histogramme représentant la distribution de la luminance

• trois histogrammes représentant respectivement la distribution des valeurs respectives des composantes rouges, bleues et vertes. [S10]

Les différents formats d’images

On peut classer les images en deux formats :

Format vectorielle

Dans une image vectorielle les données sont représentées par des formes géométriques simples qui sont décrites d’un point de vue mathématique.

Par exemple, un cercle est décrit par une information du type (cercle, position du centre, rayon). Ces images sont essentiellement utilisées pour réaliser des schémas ou des plans.

[S23]

Format matricielle

Une image matricielle est formée d’un tableau de points ou pixels. Plus la densité des points sont élevée, plus le nombre d’informationsste grand et plus la résolution de l’image est élevée. Corrélativement la place occupée en mémoire et la durée de traitement seront d’autant plus grandes.Les images vues sur un écran de télévision ou une hotographie sont des images matricielles. On obtient également des images matricielles à l’aide d’un appareil photo numérique, d’une caméra vidéo numérique ou d’un scanner. Parmices formats on peut citer :

BMP (BitMap) : Le format BMP est le format par défaut du logicielWindows. C’est un format matriciel. Les images ne sont pas compressées. Son logiciel d’origine.

Le format EPS : matriciel n’est pas très différent du EPS vectoriel. En fait seules les données contenues dans le fichier sont différentes. Ainsi un logiciel de retouche de photos tel que Photoshop permet l’importation, la modification et l’exportation de fichiers en format EPS.

GIF (GraphicalInterchange Format) : Le format GIF est un format qui a ouvert la voie à l’image sur le World Wide Web. C’est un format de compression qui n’accepte que les images en couleurs indexés codéurs 8 bits, C’est un format qui perd beaucoup de son marché suite à une bataille juridique concernant les droits d’utilisation sur Internet.

JPEG (Joint Photographique Experts Group) : Les images JPEG sont des images de 24 bits. C’est-à dire qu’elles peuvent afficher un spectre de 16 millions de couleurs. C’est la meilleure qualité d’images disponible. [S6]

Frame

Image composants la vidéo, les photogrammes[S2]

Objet

Les objets physiques sont les objets du monde réel qui apparaissent dans les scènes observées par les caméras[4].

Les objets physiques sont divisés en deux types : les objets de contexte et les objets mobiles.

Les objets de contexte

Sont des objets physiques qui sont habituellement statiques (p. ex. les murs). Dans le cas où ils ne sont pas statiques, leurs mouvements peuvent être prédits par les informations contextuelles p.ex. Les chaises, les portes sont des objets de contexte. [4]

Les objets mobiles

Sont des objets physiques qui peuvent être perçus dans les scènes par leurs mouvements [4]. Il est cependant difficile de prédire leurs mouvements P. ex. les personnes, les véhicules.

Les objets dans les vidéos sont des objets mobiles .Ils sont habituellement détectés et suivis dans plusieurs frames.

La détection de l’objet

La détection de l’objet comprend la détection d’objets et la reconnaissance de formes dans le cadre d’une séquence vidéo. Un mécanisme dedétection d’objet est nécessaire dans ne importe quel procédé de suivi soit dans chaque trame ou lorsque l’objet apparaît en premier dans la vidéo.[5]

La vidéo

Définition

La vidéo est une succession d’images animées défilant à une certaine cadence afin de créer une illusion de mouvement pour l’œil humai n.

Elle peut être analogique (signal continu d’intensité de luminance) ou numérique (suite de trames ou images). [6]

Les fondamentaux physiques et techniques

La vision

Dans le phénomène de la vision humaine, un flux lumineux composé de photons frappe l’œil.

Dans l’œil, les bâtonnets vont réagir à l’intensité de la lumière (la luminance ou Y) et les cônes vont réagir à la couleur (la chrominance ou C ).

Le cerveau effectue la synthèse de ces informations pour composer une image. L’œil humain est davantage sensible à l’intensité lumineuse (Y) qu’à la couleur (C). [S13]

La couleur

La vidéo utilise ce qui est identifié comme la synthèse additive de la couleur. Dans le système colorimétrique additif, les trois couleursprimaires sont le rouge, le vert et le bleu (RVB ou RGB dans la terminologie anglophone). En combinant ces trois couleurs primaires, il est possible de reproduire tout le spectre visible par l’œil humain. L’écran de visualisation vidéo sera donc composé d’une sériee dtriades rouge-vert-bleu. L’activation de l’ensemble de ces triades formera l’image[S13]

Le signal

En vidéo, c’est la caméra qui transforme l’information lumineuse (photons) en signal électrique (électrons). En vidéo analogique, l’intensité de ce signal électrique varie de façon continue. Le processus de transformation de l ‘information lumineuse en signal électrique est le suivant :

L’élément optique de la caméra, l’objectif, séparela lumière en trois composants le rouge, le vert, le bleu. Cette opération est réalisée en faisant passer le flux lumineux par une succession de filtres dichroïques réfléchissant certaines couleurs et en laissant passer d’autres.En vidéo professionnelle, les trois images sont projetée sur trois capteurs photo sensibles distincts formés chacun de centaines de milliers de points généralement entre 400 000 et 700 000. Ces capteurs sont nommés CCD (charged coupled device) ou dispositifs à transfe rt de charge. Les caméras domestiques ne sont généralement équipées que d’unseul capteur CCD. [S13]

Figure II.4 : Schéma de principe d’un Capture Tri-CCD (charged coupled device) [S14]

Pour chacun des points de chacun des capteurs, l’énergie lumineuse sera transformée en énergie électrique. Ainsi, à la sortie des capteurs, trois signaux électriques d’intensité variable, un signalpour chacune des trois composantes. La lumière blanche est formée par la somme des trois composantes RVB. Toutefois, elle n’est pas composée des trois couleurs primaires en quantité égale. Les propositions sont les suivantes : 100% Y = 29.9%(R) +58,7%(V) +11,4%(B)

Une information supplémentaire devra être ajoutée cesà signaux. Comme nous l’avons dit, une valeur doit être établie pourchacun des points des capteurs. C’est cette valeur pour chacun des points de chacun des pixels qui permettra de recomposer l’image sur un écran de visualisation, chacun des points de la surface d’affichage pouvant alors prendre la même valeur qu’au moment de la capture par la caméra. La restitution de l’information pour chacun des pixels se fait par balayage ligne par ligne de la surface de l’écran de reproduction, les valeurs enregistrées ourp chacun des pixels au moment de la capture étant transférées aux pixels ed la surface de reproduction. Pour synchroniser ces balayages, un signal de fin de ligne est ajouté pour chacune des lignes. Un signal de fin d’image est également inséré[S13].

Les caractéristiques d’un signal vidéo

Chaque fichier vidéo a des attributs qui décrivent ce qui constitue le signal vidéo. Ces caractéristiques comprennent:

– Châssis de taille : Il s’agit de la dimension de pixel de l’image

– Le ratio d’aspect: C’est le rapport entre la largeur et la hauteur

– Vitesse de défilement: C’est la vitesse à laquelle les images sont capturées et destinés à la lecture.

– Débit: Le taux de débit ou de données est la quanti é de données utilisées pour décrire la partie audio ou vidéo du fichier.Il est généralement mesuré en unités par seconde et peut être en kilo-octets, méga-octets ou giga-octets par seconde. En général, plus la vitesse de transmission, meilleure est la qualité.

– Le taux d’échantillonnage audio: C’est à quelle fréquence le signal audio est échantillonné lors de la conversion d’une source analogique à un fichier numérique.[7]

Affichage vidéo

La technique de la composition d’image par balayage a une conséquence : contrairement à l’image cinéma, l’image vidéo ne s’affiche pas und’ seul coup, elle s’affiche ligne par ligne, en commençant par le haut à gauche pour fini r en bas à droite. Afin d’assurer une uniformité dans la luminosité de cet affichage, end’autres termes afin que l’intensité lumineuse des pixels du haut de l’écran ne commenc pas à diminuer alors que ceux du bas viennent d’être activés, une technique spécifique a été développée. Il s’agit de la technique d’entrelacement Un premier balayage est effectué sur les lignes impaires, puis un deuxième sur les lignes paires. Il faut donc deux passages pour recomposer une image complète. La fréquence d’entrelacement s’appuie sur la fréquence du réseau électrique. Comme en Amérique du Nord la fréquence des réseauxest de 60Hz, le système de balayage est donc de 60 demi-images, soit 30 images par seconde. De façon précise, le taux de rafraîchissement est plutôt de 29,97 image s par seconde.

La norme Nord-Américaine en télévision est le NTSC(National Television Standard Committee). L’image NTSC est formée de 525 lignes. De ces lignes, seulement 486 sont utilisées pour afficher l’image. Les deux autres rincipales normes sont européennes. Il s’agit des normes PAL (Phase Alternation by Line) et SECAM (Séquentiel Couleur à Mémoire). L’image PAL ou SECAM est formée de 625ignesl dont 576 sont utilisées pour l’image. Comme la fréquence des réseaux électriques européens est de 50 Hz, le système de balayage est de 50 demi-images, soit 25 images par seconde. [S13]

Le son

Le son fera l’objet d’un traitement distinct. Le signal sonore sera distinct du signal vidéo. Il sera également enregistré sur des pistes distinctes sur le ruban vidéo.[S13]

Types de vidéo

On distingue deux grandes familles de systèmes vidéo : les systèmes vidéo analogiques et les systèmes vidéo numériques.

La vidéo analogique

La caméra balaye l’image bidimensionnelle qu’elle a devant elle par un faisceau d’électrons qui se déplace très rapidement de gauche à droite et plus lentement de haut en bas et produit une tension en fonction du temps. Elle enregistre ainsi l’intensité lumineuse, et à la fin du balayage, on a alors une trame. Le faisceau revient à l’origine pour recommencer. Le récepteur va recevoir cette intensité en fonction du temps, et pour reconstruire l’image, va répéter le processus de balayage. [8]

La vidéo numérique

Le processus de captation de l’image vidéo en modenumérique est essentiellement le même que pour la vidéo analogique. Un système optique sépare la lumière en trois composants. À la sortie toutefois, plus d’enregistr ement d’un signal électrique mais plutôt l’enregistrement d’une valeur numérique définie pour chacune des trois couleurs de chacun des pixels (RVB). Le processus de transformation d’un signal électrique et valeurs numériques s’appelle la numérisation ou l’échantillonnage. Deux paramètres servent à échantillonner un signal électrique : la fréquenced’échantillonnage et la quantification de l’échantillonnage ou le nombre de bits utilisés pour le codage. [S13]

La fréquence d’échantillonnage

Il existe un théorème appelé le théorème de Shann.o Ce théorème stipule que «l’information véhiculée par un signal dont le spectre est à support borné n’est pas modifiée par l’opération d’échantillonnage à condition que la fréquence d’échantillonnage soit au moins deux fois plus grande que la plus grande fréquence contenue dans le signal. La reconstitution du signal original peut être effectuée par un filtre passe-bas idéal de fréquence de coupure égale à la moitié de la fréquence d’échantillonnage.»

La bande passante d’un signal vidéo peut atteindre6Mhz. Pour numériser ce signal, une fréquence d’échantillonnage de 13,5Mhz sera donc utilisée. En d’autres termes, le signal vidéo sera mesuré 13 500 000 fois par seconde. Comme nous savons que l’œil est sensible à la lumière (luminance) qu’à la couleur (chrominance), souvent, la fréquence d’échantillonnage de la chrominance sera moins importante. Dans les faits, l’on utilise un échantillonnage à 13,5Mhz pour Y (luminance) et 6,75 pour C (U et V). Cet échantillonnage est donc un échantillonnage à 16 bits par pixel.

La quantification de l’échantillonnage

Un certain nombre de bits serviront à coder chacune des mesures. Nous savons que l’œil humain discerne un maximum de 256 niveaux différents de luminance. Ainsi, un codage à 8 bits est suffisant pour reproduire l’ensemble des variations perceptibles (8 = 256 combinaisons possibles) Comme chacune des composantes couleurs de l’image sera quantifiée sur 8 bits (8 bits Rouge, 8 bits Vert, 8 bits Bleu) (224= 16 777 216 combinaisons possibles) un total de 24 bits (3 octets) seront utilisés pour coder les informations relatives à un seul pixel d’une image. [S13] [25]

|

Table des matières

Introduction générale

Chapitre I : La configuration d’ OpenCV avec Visual Studio

1. Introduction

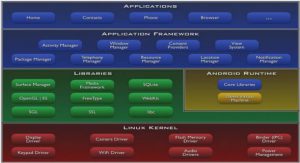

2. Présentation de la librairie OpenCV

2.1 Historique

2.2 Qu’est-ce que OpenCV

2.3 Fonctionnalités

2.4 Modules OpenCV

3. Installation et configuration OpenCV2.3.1 avec Visual Studio 2008

3.1 Téléchargement et extraction OpenCV

3.2 Mise en place des variables d’environnement

3.3 Microsoft Visual Studio 2008

3.4 Configuration de Visual Studio 2008

3.5 Configuration générale

3.6 La configuration nécessaire

4. Conclusion

Chapitre II : Notion de base sur les images et les vidéos

1. Introduction

2. L’image et sa représentation

2.1 Types d’images

2.2 Caractéristiques de l’image

2.2.1 Pixel

2.2.2 Poids de l’image

2.2.3 Bruit

2.2.4 Transparence

2.2.5 Luminance

2.2.6 Contraste

2.2.7 Histogramme

2.3 Les différents formats d’images

2.3.1 Format vectorielle

2.3.2 Format matricielle

3. Frame

4. Objet

5. La détection de l’objet

6. La vidéo

6.1 Définition

6.2 Les fondamentaux physiques et techniques

6.2.1 La vision

6.2.2 La couleur

6.2.3 Le signal

6.2.4 Affichage vidéo

6.2.5 Le son

7. Types de vidéo

7.1 La vidéo analogique

7.2 La vidéo numérique

7.2.1 La fréquence d’échantillonnage

7.2.2 La quantification de l’échantillonnage

8. Composition des fichiers vidéo

8.1 Le conteneur

8.2 Le(s) conteneur(s)

9. Les formats de fichiers vidéo

9.1 Les codecs vidéo

9.2 Les Conteneurs vidéo

10. Hiérarchie des données vidéo

10.1 Séquence vidéo (Video Sequence)

10.2 Groupe d’images (Group of Pictures)

10.3 Image (Picture)

10.4 Tranche (Slice)

10.5 Macroblocs (Macroblocks)

10.6 Blocs (Block)

11. Représentation d’une séquence vidéo

11.1 La résolution en luminance

11.2 La résolution spatiale

11.3 La résolution temporelle

12. Conclusion

Chapitre III : Les méthodes de la détection d’objets en mouvement

1. Introduction

2. Méthode de détection d’objets en mouvement

2.1 La différence temporelle des images (méthode de mouvement)

2.2 Double de différence temporelle et caractère de contour

2.3 La soustraction de l’image de fond (méthode de différence)

2.4 Méthode de détection des objets selon la Couleur

3. Suivi d’objets en mouvement (tracking)

4. Conclusion

Chapitre IV: Résultat de détection d’un objet en mouvement selon la couleur

1. Introduction

2. Environnement du travail

2.1 Environnement matériel ou le hardware

2.2 Environnement immatériel ou le software

3. Fonctions utiles de la bibliothèque OpenCV

3.1 Pour le traitement d’image

3.2 Class ImageOpenCV

3.3 Pour lire la video

3.4 Class ImageSourceVideo

4. Implémentation

4.1 Détection d’un objet en couleur rouge dans image par la bibliothèque OpenCV

4.2 Détection plusieurs objets de couleur différents dans une image

4.3 Détection d’un objet en mouvement de couleur rouge dans une scène vidéo

4.4 Détection d’un objet en mouvement de couleur jaune dans une scène vidéo

4.5 Détection d’un objet en mouvement de couleur bleu dans une scène vidéo

5. Conclusion

Conclusion générale

Bibliographie

![]() Télécharger le rapport complet

Télécharger le rapport complet