Définitions et Premières Propriétés

Les notions qui vont être présentées ici sont issues de l’article de Laurent Schwartz « Sous-espaces hilbertiens d’espaces vectoriels topologiques et noyaux associés », [Sch64]. Soit E un espace vectoriel topologique localement convexe quasi-complet, par la suite nous nous restreindrons au cas d’espaces vectoriels réels, les notations y étant entre autres moins lourdes que dans le cas complexe. Un bon rappel des notions d’e.v.t.l.c. pourra être trouver dans l’ouvrage de Walter Rudin « Functional Analysis » et dans sa traduction française « Analyse Fonctionnelle » [Rud91, Rud95]. Nous utiliserons les définitions introduites dans cette ouvrage ; un e.v.t sera par exemple toujours considéré comme étant séparé. Un e.v.t. est quasi-complet si « tout fermé borné est complet » ([Sch64, page 124]).

Lois conditionnelles et désintégrations de mesures

Comme son titre l’indique, la Section 3.2.1 fait uniquement référence à différentes projections orthogonales sur les structures hilbertiennes considérées et à leurs équivalences via l’isomorphisme I entre H et H. Dans le cas de l’interpolation optimale, l’élément « objectif », que nous avons noté ϕ dans la Section 2.2, est supposé appartenir à H. Dans le cas du conditionnement, l’élément objectif est supposé être une réalisation du processus gaussien Y associé à H, il appartient donc avec probabilité 1 à un sous-espace dense de HE et n’est d’ailleurs pas dans H avec probabilité 1 lorsque H est de dimension infinie (voir Section 3.1). Ainsi, sauf cas particulier (dimension finie), les lois conditionnelles du processus étudié ne peuvent pas être déduites à partir des seules considérations hilbertiennes énoncées dans la Section 3.2.1. Nous n’aborderons pas en détail le concept de désintégration (aussi appelé probabilité conditionnelle régulière). Signalons simplement, pour en donner une idée grossière, que le fait d’associer à chaque réalisation d’un processus une loi conditionnelle sachant un certain événement conduit à définir une probabilité de transition. On parle alors de probabilité conditionnelle régulière quand la famille de lois conditionnelles définie par la probabilité de transition considérée permet, par mélange (mixture of a family of probability measures with respect to a mixing measure), de retrouver la loi du processus initial. Voir par exemple [TV07, Par05] pour une présentation de ces concepts.

Noyaux conditionnellement positifs

Définition 4.2 : Un noyau symétrique N -conditionnellement positif est une application linéaire faiblement continue Γ de E′ dans E, (un noyau relatif à E donc)

• symétrique : ∀e′ et f′ ∈ E′, hΓe′, f′iE,E′ = hΓf′, e′iE,E′,

• N -conditionnellement positive : ∀e′ ∈ N 0, hΓe′, e′iE,E′ > 0.

On note N -L +s (E) l’ensemble des noyaux relatifs à E symétriques et N – conditionnellement positifs (voir également la Remarque 1.1). Notons que tout noyau de L +s(E) est également élément de N -L +s(E).

Proposition 4.2 : Soit Γ un noyau symétrique N -conditionnellement positif et p une projection linéaire continue sur N , soit q = idE − p. Le noyau Γq = qΓtq est un noyau hilbertien relatif à E, i.e. l’application Γq: E′ → E est linéaire, faiblement continue, symétrique et positive (ou encore Γq ∈ L +s(E), pour reprendre les notations du Chapitre 1).

|

Table des matières

Introduction

1 Sous-espaces hilbertiens et noyaux associés

1.1 Définitions et Premières Propriétés

1.2 Sous-espaces hilbertiens d’espaces « emboîtés »

1.3 Espaces de Hilbert à noyau reproduisant

1.4 Effet d’une application linéaire continue

1.5 Exemple

2 Interpolation optimale dans les sous-espaces hilbertiens : une approche spectrale

2.1 Introduction

2.2 Interpolation optimale dans les sous-espaces hilbertiens

2.3 Opérateurs intégraux et problème d’interpolation

2.4 Représentation et approximation de l’interpolateur optimal

2.5 Cas classique : nombre fini de données

2.6 Un exemple d’application

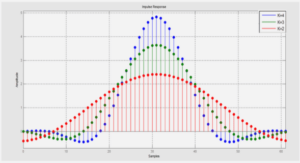

2.6.1 Noyau gaussien et valeurs sur le cercle

2.6.2 Contrainte sur la dérivée normale

2.6.3 Contrainte double

3 Conditionnement des processus gaussiens

3.1 Sous-espaces hilbertiens et processus gaussiens

3.2 Conditionnement et interpolation optimale

3.2.1 Projections orthogonales

3.2.2 Lois conditionnelles et désintégrations de mesures

3.2.3 Application de l’approche spectrale au conditionnement

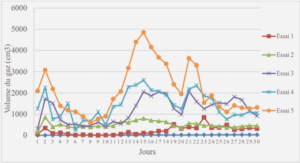

3.3 Illustration : conditionnement du drap brownien

3.3.1 Cas du quart-de-cercle

3.3.2 Cas général

4 Sous-espaces semi-hilbertiens et noyaux conditionnellement positifs

4.1 Motivations et premières définitions

4.2 Noyaux conditionnellement positifs

4.3 Un exemple

4.4 Interpolation optimale dans les sous-espaces semi-hilbertiens

4.4.1 Existence, unicité et caractérisation

4.4.2 Cas fini

Conclusion et perceptives

A Détail de certains calculs

A.1 Décomposition spectrale de l’opérateur intégral apparaissant dans la Section 2.6.1

A.2 Décomposition spectrale de l’opérateur intégrale apparaissant dans la Section 3.3.1

A.3 Formulation équivalente du Théorème 3.3

B English version of Chapter 2

B.1 Introduction

B.2 Theoretical Background : Optimal interpolation in Hilbert subspaces

B.3 Problem Adapted Integral Operator

B.4 Representation and Approximation of the Optimal Interpolator

B.5 Finite Case

B.6 Example of application

B.6.1 Gaussian kernel and value on the circle

B.6.2 Derivative Constraint

B.6.3 Double Constraint

C English version of Chapter 3

C.1 Notations and recalls

C.2 Spectral approach for conditioning

C.3 A note on regular conditional probabilities

C.4 Illustration: Conditioning the Brownian Sheet

C.4.1 The quarter-circle case

C.4.2 The general case

![]() Télécharger le rapport complet

Télécharger le rapport complet