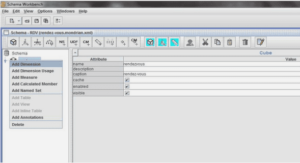

Construction de la base d’apprentissage

L’anatomie cytologique est une spécialité médicale qui étudie la composition microscopique des cellules. Les prélèvements sont étalés sur une lame puis fixés et colorés afin de reconnaître les différentes cellules présentes. Les étalements sont ensuite examinés au microscope par un cytotechnicien afin de repérer les cellules d’intérêt. Cette étape de lecture de la lame consiste en une évaluation visuelle des cellules présentes sur une lame cytologique. Le but de cette étape est soit la détection de cellules anormales ou suspectes, soit la quantification de cellules. Ceci est donc un intérêt capital pour le pathologiste qui doit établir un diagnostic fiable et valide. Le faible nombre de cellules anormales observées durant l’analyse implique une grande concentration du cytotechnologiste. A cause de ce facteur subjectif, quelques erreurs apparaissent et peuvent causer des faux négatifs.

Une approche prometteuse est d’aider le cytopathologiste dans sa recherche des cellules anormales sur la lame. Un système automatique pourrait contribuer à la détection des erreurs d’analyse pour une meilleure fiabilité. La première étape du système est la segmentation automatique des images cytologique qui consiste à séparer la scène image en régions homogènes . L’utilisation de plusieurs espaces couleur permet une description exhaustive des couleurs car les propriétés de chaque espace couleur sont susceptibles d’être exploitées. Cette description conduit à des données de grande dimensions où la possibilité d’avoir une redondance et une incohérence est élevée l’utilisation d’une méthode de réduction de dimension peut contourner ce probléme. Une analyse discriminante linéaire (LDA) est réalisée pour extraire les caractéristiques discriminantes et pertinentes afin de réduire le temps d’exécution, les redondances et le bruit.

Représentation de la couleur

Les systèmes de primaires

Le système (R,G,B) Dans le domaine de traitement d’images, les composantes couleur d’un pixel dépendent du caméra et du système d’acquisition utilisé. Cela pose différents normes mais le système (Rc, Gc, Bc) de la CIE [1] reste néanmoins le système de référence. Le système RGB est un système à trois dimensions qui peut être représenté sous la forme d’un cube (figure4.9) dont chaque axe correspond à une couleur primaire, d’origine O. La couleur est représenté par un point C qui définit le vecteur couleur

→

OC La CIE définies autres primaires, par exemple, la norme NTSC qui utilise les primaires fixées par la FCC. La norme allemande PAL fixée par EBU ou à la norme SECAM.

Le système (X,Y,Z) Les systèmes(R,G,B) présentent quelques inconvénients majeurs :

– Les composantes trichromatiques peuvent prendre des valeurs négatives.

– Les valeurs des composantes trichromatiques sont liées à la luminance qui est une combinaison linéaire des composantes trichromatiques.

– L’existence de multitude standards de système (R*,G*,B*).

En 1931, la CIE tente d’établir un système permet de résoudre les inconvénients du système (Rc, Gc, Bc) [2], dont les primaires [X], [Y] et [Z], qui sont imaginaires, une de ces primaires représente l’information de luminance, et toutes les composantes trichromatiques sont positives.

Les systèmes luminance-chrominance

Les composantes d’un système luminance-chrominance sont évaluées à partir des composantes trichromatiques R, G et B par une transformation non linéaire ou une transformation linéaire en utilisant une matrice de passage. La luminance notée L dans le système luminance-chrominance, qui peut avoir plusieurs sens selon la façon dont elle est considérée. Les systèmes luminance-chrominance sont ainsi notés (L, Chr1, Chr2). Ainsi, il existe différents types de systèmes luminance-chrominance :

Les systèmes perceptuellement uniformes

Judd à proposer de nouvelles composantes de chrominance qui tentent de réduire les disproportions entre les différents ellipses de MacAdam [3]. Ces composantes, notées u et v.

Les systèmes de télévision

Les signaux de télévision séparent l’information de luminance de celle de chrominance. Il existe deux principaux systèmes de télévision :

Le système (Y,I,Q) C’est un système défini par le standard NTSC. On peut réaliser une transformation linéaire des composantes trichromatiques du système par l’utilisation d’une matrice de passage .

Le système (Y,U,V) C’est un système défini par le standard PAL (norme allemande). Il est aussi possible d’évaluer les composantes trichromatiques à partir du système (Rc,Gc,Bc) de la CIE en utilisant une matrice de passage.

Les systèmes perceptuels

Les systèmes perceptuels ressemblent à des systèmes luminance-chrominance puisqu’ils sont composés d’une information quantifiant la luminance ainsi que de deux informations quantifiant la chrominance. Ces notions mises en évidence en 1909 par A.Henry Munsell Il existe de nombreux systèmes de ce type dans la littérature telles que : ISH, HSL, HSV, TLS, LCH, LSH, LST, ITS, … Nous distinguons deux familles de systèmes perceptuels :

Les systèmes de coordonnées polaires

Cette famille de systèmes décomposant l’information couleur en un axe de luminance et un plan de chrominance, par transposition des coordonnées cartésiennes en coordonnées polaires .

La première composante d’un système de coordonnées polaires représente l’information de luminance L, identique à la première composante du système luminance-chrominance correspondant, qui est défini par l’équation : L = ┃┃ OP ┃┃ = √CHr²₁ + CHr²₂

Les systèmes humains de perception de la couleur

Dans ce type d’espace, la couleur est décrite comme l’homme la qualifie, exprimé par trois composantes forment un système (I,S,T), La première composante I représente l’intensité correspond à l’information de luminance, ensuite la saturation S représente le niveau de coloration, et T la teinte.

Le système (I,S,T) Ce modèle correspond à une expression des composantes I, S et T dans le cube des couleurs d’un système (R,G,B). Dans cette représentation du cube des couleurs, Nous retrouvons l’axe achromatique qui correspond à l’axe d’intensité dans le système (I,S,T).

Analyse Linéaire Discriminante (LDA)

L’objectif de l’Analyse Linéaire Discriminante (LDA), est de réduire le nombre de dimensions en présentant le maximum des données. Elle cherche les axes tels que la projection des données dans l’espace engendré par ces axes permette une plus grande discrimination entre les classes .

Apprentissage et classifications supervisées

La présence d’images numériques dans des applications devient importante de jour en jour. Plusieurs formalismes existent pour modéliser l’information issue d’une image ou d’une mesure [15].Ces modélisations posent problème au niveau de la taille des donnés, ce problème peut être régler par l’utilisation d’une méthode de réduction de dimension. Nous avons choisit la méthode LDA qui nous permet de réduire la taille des données d’image en combinant les composantes couleurs et donc elle nous facilite la classification.

Notion d’apprentissage

L’apprentissage automatique (machine-Learning en anglais) est une discipline scientifique, qui est aussi l’un des champs d’étude de l’intelligence artificielle. L’apprentissage automatique fait référence au développement, à l’analyse et à l’implémentation de méthodes qui permettent à une machine (au sens large) d’évoluer grâce à un processus d’apprentissage, et ainsi de remplir des tâches qu’il est difficile ou impossible de remplir par des moyens algorithmiques plus classiques. Cette notion englobe toute méthode permettant de construire un modèle de la réalité à partir de données, soit en améliorant un modèle partiel ou moins général, soit en créant complètement le modèle ou bien capacité à améliorer les performances au fur et à mesure de l’exercice d’une activité .

Types d’apprentissage

Les algorithmes d’apprentissage peuvent se catégoriser selon le mode d’apprentissage qu’ils emploient :

L’apprentissage supervisé

Si les classes sont prédéterminées et les exemples connus, le système apprend à classer selon un modèle de classement ; on parle alors d’apprentissage supervisé (ou d’analyse discriminante).

L’apprentissage non-supervisé

Quand le système ou l’opérateur ne disposent que d’exemples, mais non d’étiquettes, et que le nombre de classe et leur nature n’ont pas été prédéterminés, on parle d’apprentissage non supervisé ou clustering.

L’apprentissage par renforcement

l’algorithme apprend un comportement étant donné une observation. L’action de l’algorithme sur l’environnement produit une valeur de retour qui guide l’algorithme d’apprentissage.

Notion de la classification

La classification est une opération de structuration qui vise à organiser un ensemble d’observation en groupes homogènes et contrastés afin de faciliter l’analyse des informations et d’effectuer des prédictions .

Principale méthodes de la classification supervisée

Machine à vecteurs de support (SVM)

Les machines à vecteurs support on été introduites en 1995 par Cortes et Vapnik [17]. Elles sont utilisées dans de nombreux problèmes d’apprentissage : reconnaissance de forme, catégorisation de texte ou encore diagnostic médical. Les SVM reposent sur deux notions : celle de marge maximale et celle de fonction noyau. Elles permettent de résoudre des problèmes de discrimination non linéaire. La marge est la distance entre la frontière de séparation et les échantillons les plus proches appelés vecteurs support. Dans un problème linéairement séparable les SVM trouvent une séparatrice qui maximise cette marge.

Astuce du noyau

Le cas linéairement séparable est peu intéressant, car les problèmes de classification sont souvent non linéaires. Pour résoudre ce point la méthode classique est de projeter les données dans un espace de dimension supérieur appelé espace de redescription. L’idée étant qu’en augmentant la dimensionnalité du problème on se retrouve dans le cas linéaire vu précédemment. Nous allons donc appliquer une transformation non linéaire Φ(•) aux vecteurs d’entrée xi tel que xi ∈ R et Φ(xi) ∈ R(e > d). Ce changement va conduire à passer d’un produit scalaire dans l’espace d’origine xi *xj à un produit scalaire Φ(xi) ∗ Φ(xj) dans l’espace de redescription l’astuce est d’utiliser une fonction noyau notée K qui évite le calcul explicite du produit scalaire dans l’espace de redescription. Les fonctions noyaux doivent satisfaire le théorème de Mercer. Nous avons alors l’égalité suivante : k(xi, xj) = Φ(xi) ∗ Φ(xj)

Un contre tous

Cette approche utilise une architecture parallèle de k machines à vecteur de support, une pour chaque classe. Chaque machine à vecteur de support résout un problème à deux classes : une classe ωi (ωi ∈ Ω), et toutes les autres Ω − ωi . nous avons M classifieurs binaires, dans cette première approche M = k . La règle de décision finale est l’application du principe « winner take all ». Pour chaque classifieur un score va être établi et l’étiquette attribuée à l’entrée xi est celle associée au classifieur qui obtient le meilleur score. Son principal inconvénient est d’effectuer un apprentissage qui peut être grandement déséquilibré. Ainsi pour un classifieur ωi nous pouvons avoir un très petit nombre d’exemples de la classe i et un grand nombre de contre exemples .

Perceptron multi couche

Il y a principalement deux facteurs qui influent sur l’apprentissage. Ce sont la qualité de l’échantillonnage d’apprentissage(les exemples qui constituent la base d’apprentissage) et la diversité des valeurs. En effet, le réseau de neurones généralisera mieux (aura plus de chances de répondre correctement en lui donnant en entrée des informations non présentes dans les exemples d’apprentissage) si la qualité de l’échantillonnage est meilleure et si les données des exemples d’apprentissage sont variées. Intuitivement, on est conscient que s’il sait répondre correctement pour un nombre fini de situations les plus diverses, il sera alors plus proche de ce que l’on veut dans une situation nouvelle.

Conclusion générale

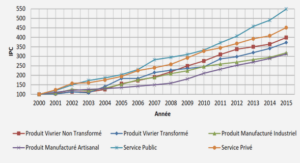

Le problème traité dans ce travail concerne l’amélioration de la classification d’image dans les conditions d’insuffisance d’informations à priori, déterministes et fiables sur l’état et la nature de la formation de l’image à l’instant de prise de vue. Notre expérience montre que la combinaison de classifieurs améliore nettement les performances du système de reconnaissance par rapport à chacun des classifieurs pris isolément, ainsi que le choix de classifieurs est important pour aboutir à une meilleure performance avec le minimum de classifieurs. Une méthode de combinaison de classifieurs d’imagerie pour une meilleure classification des scènes imagées a été proposée. La théorie de l’évidence est basée sur le principe de combinaison parallèle des systèmes répartis. Elle est générale et applicable à tout type de classifieurs.

|

Table des matières

Introduction générale

1 Représentation de la couleur et analyse discriminante

1.1 Introduction

1.2 Représentation de la couleur

1.2.1 Les systèmes de primaires

1.2.2 Les systèmes luminance-chrominance

1.2.3 Les systèmes perceptuels

1.2.4 Les systèmes d’axes indépendants

1.3 Synthèse

1.4 Analyse Linéaire Discriminante (LDA)

2 Apprentissage et classifications supervisées

2.1 Introduction

2.2 Notion d’apprentissage

2.2.1 Types d’apprentissage

2.3 Notion de la classification

2.4 Principale méthodes de la classication supervisée

2.4.1 Machine à vecteurs de support (SVM)

2.4.2 Réseaux de neurones

2.4.3 Modèle de mélanges de gaussiennes

2.4.4 Arbres de décision

2.4.5 Les K plus proches voisins

2.5 Conclusion

3 Fusion de décisions

3.1 Introduction

3.2 Principes et besoins de la combinaison des classifieurs

3.3 Définition d’un classifieur dans le cadre de la combinaison

3.4 Méthodes sans apprentissage

3.5 Méthodes avec apprentissage

3.5.1 Approche bayésienne

3.5.2 Théorie de l’évidence

3.6 Conclusion

4 Modélisation de la fusion et expérimentations

4.1 Description de la base

4.2 Construction de la base d’apprentissage

4.2.1 Espaces couleur

4.2.2 Construction de la matrice de passage

4.2.3 Étiquetage

4.2.4 Échantillonnage

4.2.5 Base d’apprentissage

4.3 Classifications

4.4 Fusions

4.5 Résultats et évaluations

4.5.1 Discussion des résultats

4.5.2 Présentation de l’interface graphique

Conclusion générale

![]() Télécharger le rapport complet

Télécharger le rapport complet