Combinaison de la RA et d’un téléphone intelligent

REVUE DE LA LITTÉRATURE

Souris versus contrôles 3D:

L’arrivée de la souris d’ordinateurs, souvent attribuée à Douglas Engelbart et son équipe (Engelbart, 1970) a permis de façonner la manière dont on interagissait avec les ordinateurs pendant des décennies. Accompagnant le clavier, la souris facilite l’accès aux interfaces pour les utilisateurs novices tout en offrant un large éventail de possibilités pour un utilisateur expert. On pourrait aller jusqu’à dire que la souris a fait passer l’informatique d’un mode axé sur le texte vers un monde axé sur les interactions humain-machine. Et malgré la simplicité apparente de l’outil, la souris d’ordinateur présente des avantages significatifs quant à ses fonctions. Tout d’abord, comme les interfaces utilisateurs sont quasi-totalement toutes conçues sur un plan 2D, n’utilisant l’occlusion que pour cacher des items n’ayant pas le focus d’attention, un outil se déplaçant sur un plan 2D est plus que suffisant pour la majorité des interfaces. Ensuite, l’appareil est constamment posé sur une surface solide, ce qui signifie qu’il n’entraîne pas de poids supplémentaire à son utilisation, en plus de laisser le curseur au même endroit si on cesse de contrôler la souris. Du même fait, la main humaine, qui a tendance à trembler et qui pourrait causer des imprécisions dans une manipulation, est alors posée et le faible poids de la souris suffit à filtrer ces tremblements pour ne laisser que les mouvements désirés. Et comme l’ont décrit Balakrishnan et al. dans leurs travaux sur une nouvelle itération de souris (Balakrishnan et al., 1997), le fait d’avoir des boutons perpendiculaires au plan de déplacement a pour effet d’augmenter la stabilité de l’outil lors de clics. Finalement, le contrôle 2D peut être encore amélioré au niveau logiciel. Les déplacements de la souris peuvent être accélérés pour permettre d’accéder plus rapidement à des objets lointains, en accord avec la loi de Fitts (Fitts, 1954), sans pour autant impacter la précision du curseur lorsque celui se déplace à basse vitesse (Blanch, Guiard et BeaudouinLafon, 2004). On peut voir que la souris est donc tout aussi adaptée aux larges interfaces. Cette caractéristique fonctionne aussi avec les interfaces 3D, tel que l’ont prouvé Elmqvist et al. (Elmqvist et Fekete, 2008).

Au-delà de l’écran monoscopique:

Si la combinaison de la souris, du clavier et de l’écran 2D s’est imposé comme étant la référence en ce qui a trait aux interfaces utilisateurs dans les 30 dernières années, cela n’a pas empêché un grand nombre de chercheurs et d’entreprises de tenter d’innover en proposant des outils différents. On dénote un succès flagrant des technologies mobiles, depuis les 10 dernières années. Cet aspect est critique à ce rapport de mémoire et sera donc abordé dans une sous-section distincte de cette revue de la littérature : 1.4 L’usage .

Écrans 3D:

Une des innovations les plus prometteuses par rapport aux interfaces traditionnelles fut de convertir les écrans 2D en écrans 3D. Dans le monde du cinéma ou du jeu vidéo, la possibilité de mieux pouvoir déceler les indices de profondeur a pour effet d’augmenter le degré d’immersion et de généralement obtenir un résultat plus impressionnant. Dans un environnement plus professionnel, le 3D peut servir comme outils aux modélisateurs 3D, par exemple, pour mieux pouvoir constater le résultat de leur travail. L’intérêt pour cette technologie est certain, mais la technique à utiliser demeure encore un chaud sujet de discussion. L’idée principale derrière chaque méthode est la même : on désire émuler la stéréoscopie, c’est-à-dire la disparité entre l’image vue par l’œil droit et l’œil gauche, qui est un des meilleurs indices de profondeur dont disposent les êtres humains. Par exemple, un observateur regardant un objet éloigné aura une image quasi identique de l’objet sur chaque œil, tandis qu’un objet rapproché entraînera deux images avec des disparités notables. Le cerveau humain est habitué à interpréter ces disparités pour déterminer la distance d’un objet observé. Les méthodes suivantes représentent quelques façons d’obtenir un tel résultat.

MÉTHODOLOGIE

Procédure:

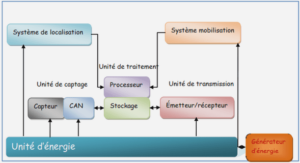

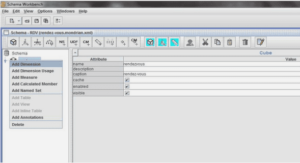

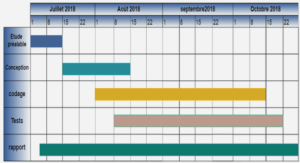

Pour remplir les deux premiers objectifs présentés précédemment ainsi que les sous-objectifs qui y sont liés, il a fallu respecter une procédure bien définie. Premièrement, pour développer le prototype d’un système multimodal de CAO intégrant les interfaces traditionnelles aux interfaces de RA, nommé à partir de désormais DualCAD, il fallait développer une architecture permettant de lier deux sous-systèmes : DesktopCAD et ARCAD. Cette architecture fut bâtie à partir de projets précédents et utilisa une ébauche de chacun de soussystèmes pour faciliter le développement et obtenir une preuve de concept. Une fois les deux ébauches étant en mesure de communiquer entre elles et de se transmettre des modèles complexes, il fut temps d’étendre les fonctionnalités du premier sous-système. Dénommé de la sorte pour indiquer qu’il s’agit d’un logiciel de CAO (CAD en anglais) utilisant les interfaces traditionnelles de bureau (Desktop en anglais), DesktopCAD se veut être un logiciel de CAO à part entière, bien qu’on se limitait aux fonctionnalités de base. Avec un clavier, une souris et un écran 2D, un utilisateur devait pouvoir créer des primitives, éditer leurs caractéristiques (couleur, texte, etc.) et les manipuler en 3D. À cela s’ajoutèrent des fonctionnalités de sauvegarde/chargement et, bien sûr, les fonctions de communication avec ARCAD. Il était prévu que les étapes d’architecture du système multimodal et le développement complet de DesktopCAD prendraient de 6 à 8 semaines.

Matériel :

Cette section aborde la liste du matériel qui fut requis pour l’accomplissement de ce projet de mémoire. Le laptop, un Dell Precision M4800 roulant Windows 7 et muni de 8 Go de RAM, d’un processeur i7-4600M @ 2.9 GHz et d’une carte graphique NVIDIA Quadro K2100M 4 Go, est l’outil principal du sous-système DesktopCAD, mais aussi le centre principal du traitement pour tout le système multimodal. Il dispose bien sûr d’un clavier et d’une carte Wifi, mais à cela s’ajoute une souris optique et une clé Bluetooth permettant de se connecter à un autre appareil à distance. Finalement, le laptop a aussi une sortie HDMI permettant d’ajouter un second écran. L’ordinateur ne fut pas sélectionné spécialement pour ce mémoire, mais il s’avéra suffisamment performant et ambivalent pour le projet.

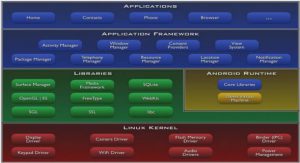

Le téléphone intelligent qui fut retenu pour servir d’outil à ARCAD est le Samsung Galaxy Note 4. Il s’agissait de la version la plus récente de la série Note qui, en plus de disposer d’une puissance de traitement agréable et d’un émetteur Wifi/Bluetooth, a un écran relativement large (5,7 pouces) et est muni d’un stylet « S Pen ». Ces deux derniers critères distinguent l’appareil de ses concurrents et étaient essentiels pour nos besoins. En effet, nous ne voulions pas risquer de manquer d’espace d’affichage (ce qui exclue les plus petits téléphones intelligents) tout en pouvant prendre le dispositif dans une seule main (ce qui exclue les tablettes) et nous avions plusieurs idées de techniques d’interaction faisant usage d’un stylet. Ce modèle s’avéra donc très pertinent au projet, bien qu’un téléphone plus petit aurait aussi fait l’affaire finalement. À noter que cet appareil utilise le système d’opération Android, ce qui fut un plus vu notre expérience passée avec le développement pour cette plateforme.

Pour effectuer le suivi avec 6 degrés de liberté des différents appareils inclus dans le soussystème ARCAD, un Polhemus Patriot fut utilisé (Figure 2.1). Celui-ci est constitué de deux capteurs, pouvant être placés sur des appareils, d’un capteur source et d’une borne pour brancher le tout, qui se connecte au laptop par une prise USB. Chaque capteur est suivi avec 6 degrés de liberté, mais est sensible aux courants magnétiques et ne peut être utilisé que d’un seul côté de la borne source à la fois (dû aux limitations d’identifier une position par un champ magnétique, il existe toujours deux réponses possibles et seule celle placée du côté dit actif de la borne source sera utilisée). L’appareil est normalement stable et assez fiable dans un rayon de quelques mètres (la précision se mesurant en centimètres), mais le modèle auquel nous avions accès perdait sa précision à partir d’un mètre. Cela ne fut pas trop limitatif pour les besoins du prototype toutefois.

|

Table des matières

INTRODUCTION

CHAPITRE 1 REVUE DE LA LITTÉRATURE

1.1 Souris versus contrôles 3D

1.2 Au-delà de l’écran monoscopique

1.2.1 Écrans 3D

1.2.2 Écrans interactifs et projection spatiale

1.2.3 Le Spectrum de la réalité mixte

1.2.4 Réalité virtuelle

1.2.5 Réalité augmentée

1.3 La CAO et la Réalité Augmentée/Virtuelle

1.4 L’usage des appareils mobiles

1.5 Des secteurs à explorer

1.5.1 Taxonomie des inputs/outputs

1.5.2 Taxonomie des techniques d’interaction

1.6 Problématique et objectifs

CHAPITRE 2 MÉTHODOLOGIE

2.1 Procédure

2.2 Matériel

2.3 Défis techniques

2.4 Architecture

2.4.1 Lien entre DesktopCAD et ARCAD

2.4.2 Lien entre ARCAD et le téléphone intelligent

2.4.3 Filmer ARCAD selon plusieurs angles

2.5 Conception

2.5.1 Calibrage du téléphone intelligent

2.5.2 Opérations 3D dans ARCAD

2.5.3 Tests utilisateurs

2.6 Implémentation

2.6.1 Obtention des coordonnées du Polhemus en C#

2.6.2 Conversion des coord. Polhemus aux coord. du monde virtuel

2.6.3 Opérations 3D dans DesktopCAD

2.6.4 Encodage des modèles

2.7 Démonstration de DualCAD à des utilisateurs experts

CHAPITRE 3 RÉSULTATS

3.1 Les deux modes

3.2 Techniques d’interaction

3.2.1 Écran tactile & stylet

3.2.2 Combinaison de la RA et d’un téléphone intelligent

3.2.3 Suivi avec 6 degrés de liberté du téléphone intelligent

3.2.4 Suivi des mains

3.2.5 Transformations directes & indirectes

3.2.6 Draw-and-Drop

3.2.7 Touch-and-Draw

3.3 Résultats de la démonstration aux utilisateurs experts

CHAPITRE 4 DISCUSSION DES RÉSULTATS

4.1 Recommandations

4.1.1 Le téléphone intelligent

4.1.2 Reconnaissance de la gestuelle

4.1.3 La CAO et la réalité mixte

4.2 Leçons apprises

4.2.1 Le matériel et le champ de vision

4.2.2 Techniques d’interaction non efficaces

CONCLUSION

LISTE DE RÉFÉRENCES BIBLIOGRAPHIQUES

![]() Télécharger le rapport complet

Télécharger le rapport complet