Propriétés de l’autonomie

Malgré les différentes définitions de l’autonomie existantes dans la littérature, ce concept semble avoir quelques propriétés communément admises, telle que son caractère relationnel et sa dépendance du contexte. Nous présentons ces propriétés, ce qui nous permettra ensuite d’identifier plusieurs types d’autonomie et leurs définitions associées.

(1) Autonomie – une notion relationnelle : Nous suivons dans ce travail le point de vue de Castelfranchi (Castelfranchi 1995) qui considère que l’autonomie ne peut être considérée qu’en termes relationnels : l’autonomie d’une entité doit être définie en relation avec ou par rapport à une autre entité. Il ne suffit donc pas de dire si un agent est ou n’est pas autonome, mais il faut aussi préciser par rapport à qui et pour quoi il l’est ou ne l’est pas. L’autonomie d’un agent doit être donc définie par rapport à une autre entité, telle qu’un autre agent, l’utilisateur, le concepteur de l’agent, le système, etc. Nous verrons par la suite comment différents types d’autonomie peuvent être considérés en fonction de l’entité qui influence l’autonomie d’un agent. L’autonomie d’un agent a aussi un objet pour lequel l’agent est ou n’est pas autonome et qui peut être tout élément cognitif définissant l’agent, par exemple un but à satisfaire, un plan à exécuter, une action à effectuer, etc. Dans (Castelfranchi 2000) les auteurs précisent que l’objet de l’autonomie est strictement lié à l’architecture d’un agent : par exemple, pour un agent cognitif qui choisit ses buts et qui planifie pour les atteindre, nous pouvons parler de l’autonomie pour planifier, l’autonomie pour choisir des buts, pour raisonner, etc. Pour un agent situé dans un environnement, nous pouvons parler de l’autonomie pour acquérir de l’information, l’autonomie pour agir, l’autonomie pour des ressources, etc.

(2) Autonomie – une notion située ou contextualisée : Cette propriété relationnelle explique partiellement la multitude de définitions existantes, qui peuvent faire référence à des objets ou entités différents pour lesquels et par rapport à qui un agent peut avoir de l’autonomie. Cependant, Hexmoor (Hexmoor 2000) considère que cette propriété relationnelle de l’autonomie ne suffit pas quand l’autonomie d’un agent est analysée, mais le contexte de l’autonomie doit être aussi pris en compte. Un agent peut être autonome dans une situation par rapport à une autre entité et pour un objet et ne pas l’être dans une autre situation (par rapport à la même entité et le même objet). Nous ne pouvons ainsi jamais parler d’une autonomie absolue d’un agent, mais de son autonomie relative à une autre entité, pour quelque chose et dans une situation. Un exemple de type de situation qui influence l’autonomie d’un agent est le rôle qu’il joue dans un groupe : comme nous le verrons dans ce manuscrit, son autonomie change beaucoup en fonction du rôle joué par l’agent ou s’il ne joue pas de rôle.

(3) Degrés d’autonomie : Si un agent n’a pas d’autonomie absolue, les auteurs de (Brainov et Hexmoor 2001) considèrent qu’il faut parler du degré d’autonomie d’un agent. En considérant la même entité qui influence l’autonomie d’un agent (par exemple, un autre agent) et un type d’objet de l’autonomie (par exemple, l’adoption des buts), nous pouvons ainsi caractériser différentes situations en fonction du degré d’autonomie qu’elles laissent à l’agent. Par exemple, si dans une situation un agent est autonome par rapport à un autre pour l’adoption de quelques buts et dans une autre situation l’agent est autonome par rapport au même agent pour l’adoption de plus de buts, il a plus d’autonomie dans la deuxième situation. Comme nous le verrons dans ce manuscrit, le degré d’autonomie d’un agent (et donc la différenciation entre plusieurs situations) est très important pour l’évaluation de situations possibles en fonction de l’autonomie laissée à l’agent, ce qui constitue l’objectif de ce travail.

Autonomie de décision

L’autonomie en exécution est une propriété désirée pour tous les agents artificiels qui doivent être capables d’exécuter les demandes de leurs utilisateurs. Par contre, l’autonomie en motivation est parfois nécessaire, mais comme nous le verrons par la suite, son existence peut créer des situations non-désirées dans les systèmes multi-agents. Dans ce travail nous nous intéressons à une forme de cette autonomie, l’autonomie en délibération (ou de décision) d’un agent – l’autonomie d’un agent par rapport à une autre entité dans un contexte de prise de décisions (délibération) concernant quelque chose. En fonction de la nature de l’entité qui influence cette autonomie, nous pouvons parler d’autonomie par rapport au concepteur, par rapport aux stimuli (à l’environnement), par rapport à l’utilisateur ou bien d’autonomie sociale (par rapport à un autre agent ou à une norme). Dans la suite nous présentons brièvement ces types d’autonomie pour analyser ensuite le dernier type d’autonomie qui nous intéresse particulièrement dans ce travail l’autonomie sociale de décision (en déliberation).

L’autonomie de décision par rapport au concepteur se réfère à la capacité d’un agent de prendre des décisions différentes de celles désirées par son concepteur. C’est un type d’autonomie rarement pris en considération à cause des inconvénients qu’elle peut provoquer : il n’y a aucune modalité de prédire ou contrôler un agent qui ne respecte même pas les spécifications de conception.

Comme argumenté dans (Castelfranchi 1995), l’autonomie par rapport aux stimuli ou à l’environnement est une caractéristique de tous les êtres humains et une caractéristique désirée des agents artificiels. Cette forme d’autonomie décrit « le problème de Descartes » : les réponses des humains à l’environnement ne sont pas provoquées, ni indépendantes des stimuli externes. C’est-àdire, le comportement d’un agent ne doit pas être contrôlé par son environnement, mais il doit être dirigé vers la satisfaction de ses buts (ou d’autres motivations internes) en prenant en compte les stimuli externes. Nous pouvons ainsi préciser que tout agent artificiel capable de satisfaire ses buts (ou ceux de son utilisateur/concepteur) est doté de cette forme d’autonomie.

L’autonomie par rapport à l’utilisateur représente peut-être le sens initial du terme dans les premières définitions d’agents autonomes : c’est l’autonomie d’un agent qui interagit avec l’utilisateur et qui doit choisir son comportement. Par exemple, dans (Bonnet and Tessier, 2007), les auteurs s’intéressent à la conception des constellations de satellites qui collaborent pour mieux observer la Terre. Ces satellites doivent avoir une autonomie par rapport à l’utilisateur pour prendre des décisions sans le contrôle des êtres humains, mais aussi une autonomie en exécution pour pouvoir créer et exécuter des plans qui satisfont leurs objectifs (ou ceux de leurs utilisateurs). En général, cette autonomie par rapport à l’utilisateur d’un agent peut varier en fonction de la situation : parfois l’agent prend des décisions tout seul, parfois c’est l’utilisateur qui prend ces décisions. Le passage du contrôle sur son comportement entre un agent et son utilisateur (ou vice-versa) est appelé dans la littérature autonomie adaptable. Par exemple, dans le projet e-Elves (Tambe et al. 2002), les auteurs s’intéressent à comment un agent peut apprendre à adapter son autonomie en fonction du problème à résoudre : certaines décisions sont trop importantes pour être prises par l’agent et l’utilisateur doit les prendre, mais parfois l’utilisateur n’est pas joignable ou il prend trop de temps à décider, ce qui menace la coordination entre les agents dans le système. Un agent doit donc décider quand il faut adapter son autonomie de décision en laissant l’utilisateur prendre les décisions ou en les prenant tout seul. L’autonomie adaptable pose des problèmes de recherche intéressants et pas encore résolus ; cependant dans ce travail nous ne considérons pas les interactions des agents avec leur(s) utilisateur(s) et nous ne nous intéressons donc pas à cette forme d’autonomie.

Le type d’autonomie auquel ce travail s’intéresse est l’autonomie sociale – l’autonomie de décision d’un agent dans un contexte social, c.-à-d., par rapport à d’autres agents ou par rapport à des entités sociales telles que des organisations, systèmes normatifs, etc. Comme nous le verrons par la suite, l’autonomie sociale est une caractéristique importante d’un agent au sein d’un système multiagents dans lequel il interagit avec d’autres agents et dans lequel son comportement est limité par des structures organisationnelles ou normatives.

Autonomie sociale dans les systèmes à base de normes

Il est communément admis (Dignum 1999) que l’utilisation d’autonomie introduit un degré de nondéterminisme dans le comportement du système, puisque la réponse d’un agent autonome dans une interaction n’est pas connue a priori. Les concepteurs des systèmes multi-agents ouverts et hétérogènes (avec des agents potentiellement différents) ne peuvent donc pas prédire le comportement des agents dans un système. Souvent, pour assurer un comportement global cohérent malgré l’autonomie locale, des normes , des conventions (Tuomela, 1995), des structures organisationnelles (Hubner 2003) sont utilisées. Nous présenterons ces concepts dans le Chapitre 2, mais pour l’instant nous pouvons considérer, dans son sens le plus large, une norme comme une obligation pour un ensemble d’agents d’effectuer ou de ne pas effectuer une action. Sans normes, un agent autonome décide d’adopter ou non un but d’un autre agent en fonction seulement de ses propres buts. L’existence des normes modifie la prise de décision de l’agent : il peut y avoir des normes qui l’obligent à adopter un but d’un autre agent même si ce but ne correspond pas à ses propres buts ou des normes qui lui interdisent de poursuivre des buts. L’autonomie sociale d’un agent par rapport à un autre agent est donc fortement influencée par les normes existantes dans le système. Des conflits entre les normes sont néanmoins possibles, comme par exemple une norme qui oblige un agent à adopter un but délégué par un autre agent et une norme qui lui interdit de poursuivre ce but. Les agents doivent être donc capables de raisonner sur les normes qui limitent leur autonomie de décision et peut-être de décider de désobéir à de telles normes. Les agents capables de décider d’obéir ou non à une norme sont appelés des agents autonomes par rapport aux normes. Conte et al. (Conte et al. 1999) identifient plusieurs cas d’autonomie d’un agent par rapport aux normes. Une norme étant un concept du niveau système, donc initialement externe aux agents, les agents doivent adopter les normes, c.-à-d., les reconnaître comme étant des normes et accepter le fait qu’ils sont concernés par elles. Un agent est autonome par rapport à l’adoption d’une norme s’il n’adopte pas cette norme soit parce qu’il ne la reconnaît pas comme norme ou parce qu’il considère que la norme ne le concerne pas. Même si l’agent adopte une norme, un agent doit décider de l’obéir (d’avoir le comportement spécifié par la norme) ou de la violer (d’avoir un comportement différent). Un agent qui décide de violer une norme est considéré autonome par rapport à l’obéissance à une norme. Finalement, un agent autonome par rapport aux normes peut prendre l’initiative de proposer ou de modifier des normes et peut veiller sur la satisfaction des normes par d’autres agents en évaluant leur comportement et en imposant des sanctions si nécessaire

Avoir de l’autonomie

Avoir de l’autonomie (en délibération) est une caractéristique du processus de décision de l’agent : un agent est considéré avoir de l’autonomie quand son processus de décision est autonome. Certains auteurs considèrent que la prise de décision d’un agent est autonome si elle est réalisée seulement à partir de ses propres buts (Castelfranchi 1995) ou motivations (Luck and d’Inverno 2001), ou si elle ne dépend pas du comportement d’un autre agent (Castelfranchi 2000). En ce qui concerne l’autonomie par rapport aux normes, elle existe simplement si l’agent peut prendre des décisions par rapport aux normes (Conte et al. 1999). D’autres auteurs, comme Hexmoor (Hexmoor 2000), considèrent qu’avoir de l’autonomie est équivalent au fait que l’agent est libre de décider (il a du libre-arbitre). Un observateur externe à un agent ne peut pas savoir si l’agent prend des décisions ou si ses réponses sont codées en dur, ni quels sont les facteurs pris en compte dans le processus de décisions (seulement les propres buts, des relations de dépendance, etc.). Pour analyser avec cette perspective l’autonomie d’un agent, nous devons prendre un point de vue interne à l’agent. Nous avons appelé cette perspective, une perspective interne sur l’autonomie d’un agent (Carabelea et al. 2004). La première impression est que ce type d’autonomie n’est pas désirable dans les systèmes multiagents. Si un agent peut décider d’adopter ou pas un but ou d’obéir ou pas à une norme, il existe le risque qu’il prenne des décisions contraires à l’intérêt du système. Le système fonctionnerait donc mieux avec des agents sans autonomie. Ceci n’est pas vrai, comme plusieurs auteurs l’ont mis en évidence. Luck et d’Inverno (Luck and d’Inverno 2001) considèrent qu’un agent sans autonomie sera utilisé comme esclave par les autres agents parce qu’il ne refusera pas leurs demandes d’adoptions de buts. Conte et al. (Conte et al. 1999) incluent dans leur définition de l’autonomie par rapport aux normes la possibilité d’un agent de proposer ou de modifier des normes. Verhagen (Verhagen 2000) montre l’utilité des agents avec ce type d’autonomie dans l’obtention d’une coordination globale parce qu’ils sont capables de modifier les normes existantes et de les imposer aux autres agents. Pour modifier les normes existantes, un agent doit raisonner sur elles, sur leurs conséquences et sur comment leur changement améliora les performances du système – autrement dit, il doit avoir une autonomie de décision par rapport à ces normes. Cette perspective sur l’autonomie s’intéresse à la prise de décision d’un agent pour voir si l’agent peut ou ne peut pas prendre une décision. Si cette prise de décision est impossible (l’agent ne sait pas décider, son architecture interne ne le lui permet pas), l’agent n’a pas d’autonomie pour cette prise de décision. Si elle est interdite, pas libre, imposée de l’extérieur, alors l’agent n’a pas d’autonomie par rapport à l’entité qui lui impose une décision. Pour résumer: Un agent est considéré avoir de l’autonomie par rapport à une entité (autre agent, norme) pour prendre une décision quand sa prise de décision n’est pas influencée par cette entité.

Contraintes sur la décision d’un agent

L’autonomie qu’un agent a dans son processus de décision dépend des facteurs qui influencent ce processus. Dans ce manuscrit nous utilisons le terme « contrainte » pour ces facteurs en provenance d’autres entités externes (agents, organisations, etc.) qui réduisent l’autonomie d’un agent. Nous pouvons classer ces contraintes en fonction du type de coordination qui les génère, mais aussi en fonction de ce qu’elles limitent, la prise de décision ou le comportement d’un agent. Pour mieux décrire ces types de contraintes nous allons nous appuyer sur la description d’un système multi-agents que nous utilisons comme exemple ci-dessous. Ce système est basé sur celui proposé par (Bourne et al., 2000). Il contient des agents qui se déplacent sur une grille pour trouver et exécuter des tâches. Ces tâches peuvent être simples (ST – Simple Task) et effectuées par un seul agent ou coopératives (CT – Cooperative Task) et effectuées par l’effort conjoint de plusieurs agents. L’exécution d’une tâche donne un profit aux agents, les profits des CT étant partagés par les agents coopérant à leur exécution. Les agents ont besoin d’interagir pour former des accords pour s’aider les uns les autres à effectuer des CT. Les agents peuvent faire partie ou non d’une société – les agents qui en font partie sont sujets d’une norme qui leur interdit de violer les contrats avec d’autres membres de la société. Un agent qui ne fait pas partie de la société peut profiter et donc rompre son contrat avec un autre agent, mais d’autres agents peuvent faire la même chose et rompre leurs contrats avec lui. Considérons maintenant les contraintes qui limitent les agents dans ce système. Ces contraintes sont issues du besoin de coordination. Comme les mécanismes de coordination possibles, nous pouvons les diviser en contraintes subjectives et en contraintes objectives :

Les contraintes subjectives concernent les contraintes interpersonnelles. Elles sont issues des interactions ou de besoin d’interagir avec d’autres agents. Par exemple, dans le système décrit ci dessus, un agent qui veut effectuer une CT ne peut pas le faire tout seul. Il a besoin de l’aide des autres agents pour satisfaire son but, il dépend d’eux. Cette dépendance est issue des relations existantes entre les agents et représente leurs essais de coordonner leurs activités – elle constitue ainsi une contrainte interpersonnelle qui limite l’agent. Etant donné les définitions de l’autonomie sociale présentées auparavant, nous pouvons conclure que cet agent n’a pas d’autonomie par rapport à d’autres agents pour l’exécution d’une CT.

Les contraintes objectives concernent les contraintes institutionnelles. Elles sont issues des mécanismes de coordination formels existants dans le système, tels que les structures organisationnelles ou les normes institutionnelles. Par exemple, dans le système décrit ci-dessus, un agent décide de faire partie d’une société dans laquelle il sera sujet d’une norme. Cette norme contraint son comportement et sa prise de décision : chaque fois qu’il forme un accord avec un autre agent pour co-exécuter une CT, la norme l’oblige à respecter cet accord, c.-à-d., d’avoir un comportement orienté vers la co-exécution de la CT. Bien évidemment, un agent peut avoir un comportement autonome par rapport à la norme et lui désobéir, mais il risque de subir des conséquences (comme par exemple des sanctions). Nous pouvons aussi faire une différence entre les contraintes qui limitent l’autonomie d’un agent en fonction de la perspective sur l’autonomie qui est limitée par elles. Nous pouvons ainsi parler de contraintes internes (décisionnelles) et contraintes externes (comportementales) :

Les contraintes décisionnelles sont les contraintes qui limitent l’autonomie en délibération d’un agent. Un exemple de ce type de contrainte dans le système que nous utilisons comme exemple est l’impossibilité d’un agent de satisfaire tout seul une CT. Cette dépendance contraint sa prise de décision – il ne peut pas décider librement sans être influencé par d’autres parce qu’il dépend d’eux. Comme nous l’avons discuté ci-dessus, cette contrainte limite l’autonomie de décision d’un agent.

Les contraintes comportementales sont les contraintes qu’un agent doit désobéir pour être considéré être dans un comportement autonome. Dans notre exemple, les agents forment des contrats pour l’exécution en coopération des CT. Ces accords, une fois créés, représentent des contraintes qui limitent les comportements possibles des agents qui sont maintenant obligés de participer à la coexécution des CT pour lesquelles ils se sont engagés. Un agent qui désobéit à son contrat (ou qui désobéit à la norme le renforçant) pourra être qualifié d’être autonome (c.-à-d. avoir un comportement autonome par rapport à cette contrainte).

Synthèse

Pour résumer, les contraintes comportementales sont des contraintes qui apparaissent suite à des actions d’un agent, telles que l’adoption d’une norme ou l’entrée dans une société. Parce que ces contraintes sont établies par le comportement de l’agent, nous les appelons aussi des contraintes établies. Quant aux contraintes décisionnelles, elles représentent le potentiel de prise de décision d’un agent, raison pour laquelle nous les appelons aussi des contraintes potentielles ou inhérentes. Nous voulons souligner le fait que la différence entre les contraintes décisionnelles et contraintes comportementales n’est pas toujours évidente. Dans l’exemple ci-dessus, avant d’être adoptée, une norme représente une contrainte décisionnelle – elle limitera la liberté de décision d’un agent. Si l’agent adopte la norme, elle représente une contrainte établie – si l’agent refuse d’essayer de remplir son accord, il viole la norme et il est autonome par rapport à elle.

|

Table des matières

INTRODUCTION GENERALE

OBJECTIFS

STRUCTURE DU MANUSCRIT

I. ETAT DE L’ART

INTRODUCTION

1. AUTONOMIE DANS LES SYSTEMES MULTI-AGENTS

1.1. Définitions de l’autonomie dans les systèmes multi-agents

1.1.1. Propriétés de l’autonomie

1.1.2. Différents types d’autonomie dans les systèmes multi-agents

1.1.3. Autonomie sociale dans les interactions

1.1.4. Autonomie sociale dans les systèmes à base de normes

1.2. Deux perspectives sur l’autonomie

1.2.1. Etre autonome

1.2.2. Avoir de l’autonomie

1.3. Autonomie – contrôle – coordination

1.3.1. Relations entre coordination, contrôle et autonomie

1.3.2. Types de coordination

1.4. Contraintes sur la décision d’un agent

1.5. Synthèse

2. COORDINATION ET CONTRAINTES INSTITUTIONNELLES

2.1. Quelques modèles organisationnels

2.2. Normes

2.2.1. Différents types de normes

2.2.2. Modèles de normes

2.3. Rôles et relations entre rôles

2.3.1. Définitions des rôles

2.3.2. Structures organisationnelles

2.3.3. Discussion

2.4. Renforcement des normes

2.4.1. Institutions électroniques

2.4.2. Sanctions

2.5. Synthèse

3. COORDINATION ET CONTRAINTES INTERPERSONNELLES

3.1. Différentes approches pour coordonner des agents

3.1.1. Cadres (framework) de coordination – le modèle TAEMS/GPGP

3.1.2. Interactions entre agents

3.1.3. Discussion

3.2. Engagements sociaux

3.2.1. Plusieurs types d’engagements dans les systèmes multi-agents

3.2.2. Caractéristiques des engagements sociaux

3.2.3. Discussion

3.3. Théorie de la dépendance

3.4. Théorie du pouvoir social

3.4.1. Pouvoirs individuels

3.4.2. Relations de pouvoir entre agents

3.4.3. Vers des pouvoirs institutionnels

3.4.4. Discussion

3.5. Synthèse

4. RAISONNEMENT SOCIAL DANS LES SYSTEMES MULTI-AGENTS

4.1. Architectures et modèles d’agents

4.1.1. Architectures d’agents individuels et sociaux

4.1.2. Architectures d’agents normatifs

4.2. Types de raisonnement

4.3. Raisonnement a priori et a posteriori

4.3.1. Raisonnement a posteriori interpersonnel et institutionnel

4.3.2. Raisonnement a priori

4.4. Synthèse

SYNTHESE

II. MODELE

INTRODUCTION

5. FONDEMENTS DU MODELE

5.1. Notions de base

5.2. Interactions entre agents

5.2.1. Modèle d’engagement social

5.2.2. Interactions entre agents et politiques sociales

5.3. Synthèse

6. ENGAGEMENTS SOCIAUX INSTITUTIONNELS

6.1. Contraintes institutionnelles

6.2. Représentation à base d’engagements et politiques sociales

6.3. Définition et attribution de rôle

6.3.1. Définition de rôle à l’aide d’engagements sociaux

6.3.2. Jouer un rôle

6.4. Renforcement d’engagements par l’agent institutionnel

6.4.1. Caractéristiques d’un agent institutionnel

6.4.2. Comment imposer des sanctions aux agents autonomes ?

6.5. Synthèse

7. POUVOIR SOCIAL ET AUTONOMIE

7.1. Pouvoirs individuels

7.1.1. Pouvoir d’exécution – can

7.1.2. Pouvoir déontique – may

7.1.3. Pouvoir individuel – power of

7.2. Relations de dépendance

7.2.1. Relations de dépendance entre agents – depends

7.2.2. Relations de dépendance entre agents et rôles – role_depends

7.2.3. Situations de dépendance

7.3. Pouvoir indirect et pouvoir social

7.3.1. Relations de pouvoir social interpersonnel

7.3.2. Relations de pouvoir social institutionnel

7.3.3. Pouvoir social – power over

7.3.4. Pouvoir indirect – indirect power of

7.4. Autonomie d’un agent

7.4.1. Capacité d’autonomie d’un agent – has autonomy

7.4.2. Comportement autonome d’un agent – is autonomous

7.5. Synthèse

SYNTHESE

III. ILLUSTRATION ET MISE EN ŒUVRE DU MODELE

INTRODUCTION

8. RAISONNEMENT A BASE D’AUTONOMIE

8.1. Raisonnement dans un contexte interpersonnel

8.2. Raisonnement dans un contexte institutionnel

8.2.1. Interactions entre agents dans un contexte institutionnel

8.2.2. Interactions entre un agent et une organisation

8.3. Raisonnement a posteriori – autonomie – types d’agents

8.4. Synthèse

9. RAISONNEMENT A PRIORI INSTITUTIONNEL

9.1. Signification pour un agent de jouer un rôle

9.1.1. Influence du rôle sur l’individu

9.1.2. Influence du rôle d’un individu sur ses relations sociales

9.2. Evaluer un rôle en terme de pouvoirs sociaux et d’autonomie

9.2.1. Pouvoirs et autonomie gagnés et perdus en jouant un rôle

9.2.2. Raisonnement à base d’autonomie

9.3. Point de vue d’une organisation

9.4. Synthèse

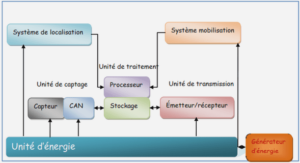

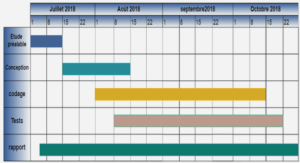

10. REALISATION : ADOMO

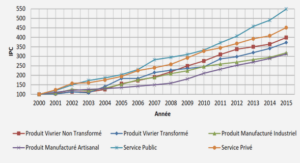

10.1. Description du scénario

10.2. ADOMO sur des objets portables

10.2.1. Négociation entre agents

10.2.2. Améliorations – utilisation d’un agent broker

10.2.3. Synthèse

10.3. Raisonnement à base d’autonomie dans ADOMO

10.3.1. Description de l’organisation ADOMO

10.3.2. Evaluation de rôle dans ADOMO

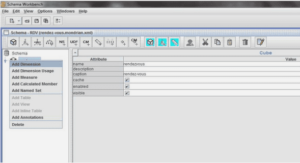

10.3.3. Réalisation en Prolog

10.4. Synthèse

SYNTHESE

CONCLUSIONS ET PERSPECTIVES

CONCLUSIONS

PERSPECTIVES

BIBLIOGRAPHIE

PUBLICATIONS DE L’AUTEUR

ANNEXE

![]() Télécharger le rapport complet

Télécharger le rapport complet